Modellkatalog und Sammlungen im Azure KI Foundry-Portal

Wichtig

Die in diesem Artikel markierten Elemente (Vorschau) sind aktuell als öffentliche Vorschau verfügbar. Diese Vorschauversion wird ohne Vereinbarung zum Servicelevel bereitgestellt und sollte nicht für Produktionsworkloads verwendet werden. Manche Features werden möglicherweise nicht unterstützt oder sind nur eingeschränkt verwendbar. Weitere Informationen finden Sie unter Zusätzliche Nutzungsbestimmungen für Microsoft Azure-Vorschauen.

Der Modellkatalog im Azure KI Foundry-Portal ist der Hub, um eine Vielzahl von Modellen zu entdecken und zu verwenden, mit denen Sie generative KI-Anwendungen erstellen können. Der Modellkatalog enthält Hunderte von Modellen von Modellanbietern wie Azure OpenAI Service, Mistral, Meta, Cohere, NVIDIA und Hugging Face, einschließlich Modelle, die Microsoft trainiert hat. Modelle von anderen Anbietern als Microsoft sind Nicht-Microsoft-Produkte, wie in den Microsoft-Produktbedingungen definiert und unterliegen den mit den Modellen gelieferten Geschäftsbedingungen.

Modellsammlungen

Der Modellkatalog organisiert Modelle in unterschiedliche Sammlungen:

Kuratiert durch Azure KI: Die beliebtesten Nicht-Microsoft-Modelle mit offener Gewichtung und proprietäre Modelle, gepackt und optimiert für den nahtlosen Einsatz auf der Azure KI-Plattform. Die Verwendung dieser Modelle unterliegt den Lizenzbedingungen der Modellanbieter. Wenn Sie diese Modelle im Azure KI Foundry-Portal bereitstellen, unterliegt deren Verfügbarkeit der entsprechenden Azure-Vereinbarung zum Servicelevel (SLA)und Microsoft bietet Unterstützung für Bereitstellungsprobleme.

Modelle von Partnern wie Meta, NVIDIA oder Mistral AI sind Beispiele für Modelle, die in dieser Sammlung im Katalog zur Verfügung stehen. Sie können diese Modelle identifizieren, indem Sie auf den Modellkacheln im Katalog nach einem grünen Häkchen suchen. Sie können auch nach der Sammlung Kuratiert durch Azure KI filtern.

Exklusiv in Azure verfügbare Azure OpenAI-Modelle: Azure OpenAI-Flagship-Modelle, die über eine Integration mit Azure OpenAI Service verfügbar sind. Microsoft unterstützt diese Modelle und deren Verwendung gemäß den Produktbedingungen und dem SLA für Azure OpenAI Service.

Offene Modelle aus dem Hugging Face-Hub: Hunderte von Modellen aus dem Hugging Face-Hub für echtzeitbasierte Rückschlüsse mit verwalteten Compute Services. Hugging Face erstellt und unterhält die in dieser Sammlung aufgelisteten Modelle. Um Hilfe zu erhalten, verwenden Sie das Hugging Face-Forum oder den Hugging Face-Support. Erfahren Sie mehr in Bereitstellen offener Modelle mit Azure KI Foundry.

Mithilfe dieses Formulars können Sie eine Anforderung senden, um dem Modellkatalog ein Modell hinzuzufügen.

Übersicht der Modellkatalogfunktionen

Sie können Modelle suchen und entdecken, die Ihren Anforderungen über keyword search und filters entsprechen. Der Modellkatalog bietet auch die Benchmarkmetriken für Modellleistung für ausgewählte Modelle. Sie können auf den Benchmark zugreifen, indem Sie auf Compare Models oder auf die Registerkarte „Benchmark“ der Modellkarte klicken.

Auf der Modellkarte finden Sie:

- Schnelle Fakten: Sie können wichtige Informationen zum Modell auf einen schnellen Blick sehen.

- Details: Diese Seite enthält die detaillierten Informationen zum Modell, einschließlich Beschreibung, Versionsinformationen, unterstützter Datentyp usw.

- Benchmarks: Sie finden Benchmarkmetriken für Leistung für ausgewählte Modelle.

- Vorhandene Bereitstellungen: Wenn Sie das Modell bereits bereitgestellt haben, finden Sie es auf der Registerkarte „Vorhandene Bereitstellungen“.

- Codebeispiele: Sie finden die grundlegenden Codebeispiele, um mit der KI-Anwendungsentwicklung zu beginnen.

- Lizenz: Sie finden rechtliche Informationen zur Modelllizenzierung.

- Artefakte: Diese Registerkarte wird nur für geöffnete Modelle angezeigt. Sie können die Modellressourcen anzeigen und über die Benutzeroberfläche herunterladen.

Modellbereitstellung: Azure OpenAI

Weitere Informationen zu Azure OpenAI-Modellen finden Sie unter Was ist Azure OpenAI Service?.

Modellbereitstellung: Verwaltete Computeressourcen und serverlose APIs

Zusätzlich zu Azure OpenAI Service-Modellen bietet der Modellkatalog zwei unterschiedliche Möglichkeiten zum Bereitstellen von Modellen für Ihre Verwendung: Verwaltete Computes und serverlose APIs.

Die für jedes Modell verfügbaren Bereitstellungsoptionen und Features variieren, wie in den folgenden Tabellen beschrieben. Erfahren Sie mehr über die Datenverarbeitung mit den Bereitstellungsoptionen.

Funktionen der Modellimplementierungsoptionen

| Features | Verwaltete Computeressourcen | Serverlose API (Pay-per-Token) |

|---|---|---|

| Bereitstellungserfahrung und Abrechnung | Modellgewichtungen werden für dedizierte VMs mit verwalteter Computeressource bereitgestellt. Eine verwaltete Computeressource, die über eine oder mehrere Bereitstellungen verfügen kann, stellt eine REST-API für den Rückschluss zur Verfügung. Ihnen werden die VM-Kernstunden in Rechnung gestellt, welche die Bereitstellungen verwenden. | Der Zugriff auf Modelle erfolgt über eine Bereitstellung, die eine API für den Zugriff auf das Modell bereitstellt. Die API bietet den Zugriff auf das Modell, das von Microsoft gehostet und verwaltet wird, um Rückschlüsse zu ermöglichen. Sie werden für Eingaben und Ausgaben an die APIs in Rechnung gestellt, in der Regel in Token. Preisinformationen werden vor der Bereitstellung bekannt gegeben. |

| API-Authentifizierung | Schlüssel und Microsoft Entra-Authentifizierung. | Nur Schlüssel. |

| Inhaltssicherheit | Verwenden Sie Dienst-APIs der Azure KI Inhaltssicherheit. | Azure KI Inhaltssicherheit-Filter sind integriert mit Rückschluss-APIs verfügbar. Azure KI Inhaltssicherheit-Filter werden separat abgerechnet. |

| Netzwerkisolation | Konfigurieren von verwalteten Netzwerken für Azure KI Foundry-Hubs. | Verwaltete Computeressourcen folgen der Flageinstellung für den öffentlichen Netzwerkzugriff (Public Network Access, PNA) Ihres Hubs. Weitere Informationen finden Sie später in diesem Artikel im Abschnitt Netzwerkisolation für Modelle, die über serverlose APIs bereitgestellt werden. |

Verfügbare Modelle für unterstützte Bereitstellungsoptionen

Die folgende Liste enthält Serverlose API-Modelle. Informationen zu Azure OpenAI-Modellen finden Sie unter Azure OpenAI-Dienstmodelle.

| Modell | Verwaltete Computeressourcen | Serverlose API (Pay-per-Token) |

|---|---|---|

| Modelle der AI21-Familie | Nicht verfügbar | Jamba-1.5-Mini Jamba-1.5-Large |

| Modelle der Cohere-Familie | Nicht verfügbar | Cohere-command-r-plus-08-2024 Cohere-command-r-08-2024 Cohere-command-r-plus Cohere-command-r Cohere-embed-v3-english Cohere-embed-v3-multilingual Cohere-rerank-v3-english Cohere-rerank-v3-multilingual |

| DeepSeek-Modelle von Microsoft | Nicht verfügbar | DeepSeek-R1 |

| Gretel | Nicht verfügbar | Gretel-Navigator |

| KI-Familienmodelle für das Gesundheitswesen | MedImageParse MedImageInsight CxrReportGen Virchow Virchow2 Prism BiomedCLIP-PubMedBERT microsoft-llava-med-v1.5 m42-health-llama3-med4 biomistral-biomistral-7b microsoft-biogpt-large-pub microsoft-biomednlp-pub stanford-crfm-biomedlm medicalai-clinicalbert microsoft-biogpt microsoft-biogpt-large microsoft-biomednlp-pub |

Nicht verfügbar. |

| JAIS | Nicht verfügbar | jais-30b-chat |

| Meta Llama-Familienmodelle | Llama-3.3-70B-Instruct Llama-3.2-3B-Instruct Llama-3.2-1B-Instruct Llama-3.2-1B Llama-3.2-90B-Vision-Instruct Llama-3.2-11B-Vision-Instruct Llama-3.1-8B-Instruct Llama-3.1-8B Llama-3.1-70B-Instruct Llama-3.1-70B Llama-3-8B-Instruct Llama-3-70B Llama-3-8B Llama-Guard-3-1B Llama-Guard-3-8B Llama-Guard-3-11B-Vision Llama-2-7b Llama-2-70b Llama-2-7b-chat Llama-2-13b-chat CodeLlama-7b-hf CodeLlama-7b-Instruct-hf CodeLlama-34b-hf CodeLlama-34b-Python-hf CodeLlama-34b-Instruct-hf CodeLlama-13b-Instruct-hf CodeLlama-13b-Python-hf Prompt-Guard-86M CodeLlama-70b-hf |

Llama-3.3-70B-Instruct Llama-3.2-90B-Vision-Instruct Llama-3.2-11B-Vision-Instruct Llama-3.1-8B-Instruct Llama-3.1-70B-Instruct Llama-3.1-405B-Instruct Llama-3-8B-Instruct Llama-3-70B-Instruct Llama-2-7b Llama-2-7b-chat Llama-2-70b Llama-2-70b-chat Llama-2-13b Llama-2-13b-chat |

| Modelle der Microsoft Phi-Familie | Phi-3-mini-4k-Instruct Phi-3-mini-128k-Instruct Phi-3-small-8k-Instruct Phi-3-small-128k-Instruct Phi-3-medium-4k-instruct Phi-3-medium-128k-instruct Phi-3-vision-128k-Instruct Phi-3.5-mini-Instruct Phi-3.5-vision-Instruct Phi-3.5-MoE-Instruct Phi-4 |

Phi-3-mini-4k-Instruct Phi-3-mini-128k-Instruct Phi-3-small-8k-Instruct Phi-3-small-128k-Instruct Phi-3-medium-4k-instruct Phi-3-medium-128k-instruct Phi-3.5-mini-Instruct Phi-3.5-vision-Instruct Phi-3.5-MoE-Instruct Phi-4 |

| Modelle der Mistral-Familie | mistralai-Mixtral-8x22B-v0-1 mistralai-Mixtral-8x22B-Instruct-v0-1 mistral-community-Mixtral-8x22B-v0-1 mistralai-Mixtral-8x7B-v01 mistralai-Mistral-7B-Instruct-v0-2 mistralai-Mistral-7B-v01 mistralai-Mixtral-8x7B-Instruct-v01 mistralai-Mistral-7B-Instruct-v01 |

Mistral Large (2402) Mistral Large (2407) Mistral-small Ministral-3B Mistral-NeMo |

| Nixtla | Nicht verfügbar | TimeGEN-1 |

Modelllebenszyklus: Einstellung und Außerbetriebnahme

KI-Modelle entwickeln sich schnell, und wenn eine neue Version oder ein neues Modell mit aktualisierten Funktionen in derselben Modellfamilie verfügbar wird, können ältere Modelle im KI Foundry-Modellkatalog eingestellt werden. Um einen reibungslosen Übergang zu einer neueren Modellversion zu ermöglichen, bieten einige Modelle Benutzern die Möglichkeit, automatische Updates zu aktivieren. Weitere Informationen zum Modelllebenszyklus verschiedener Modelle, anstehende Termine der Modelldeaktivierung und vorgeschlagene Ersatzmodelle und Versionen finden Sie unter:

- Einstellung und Außerbetriebnahme des Azure OpenAI Service-Modells

- Einstellung und Außerbetriebnahme des serverlosen API-Modells

Verwaltete Computeressourcen

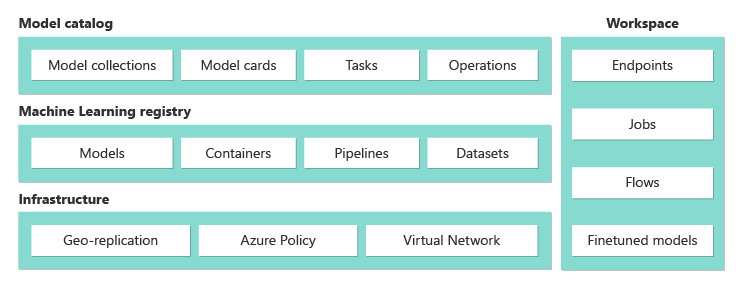

Die Funktionalität, Modelle als verwaltete Compute Services bereitzustellen, baut auf Plattformfunktionen von Azure Machine Learning auf, um eine nahtlose Integration der umfangreichen Sammlung von Modellen im Modellkatalog über den gesamten Lebenszyklus von Vorgängen für große Sprachmodelle (Large Language Model, LLM) hinweg zu ermöglichen.

Verfügbarkeit von Modellen für die Bereitstellung als verwaltete Compute Services

Die Modelle werden über Azure Machine Learning-Registrierungen zur Verfügung gestellt. Diese Registrierungen ermöglichen einen Ansatz „maschinelles Lernen zuerst“ zum Hosten und Verteilen von Azure Machine Learning-Ressourcen. Zu diesen Ressourcen gehören Modellgewichte, Containerruntimes für das Ausführen der Modelle, Pipelines zum Auswerten und Feinabstimmen der Modelle sowie Datasets für Benchmarks und Beispiele.

Die Registrierungen bauen auf einer hoch skalierbaren und unternehmensfähigen Infrastruktur auf, die Folgendes bietet:

Liefert latenzarme Modellartefakte für den Zugriff für alle Azure-Regionen mit integrierter Georeplikation.

Unterstützt Unternehmenssicherheitsanforderungen wie beispielsweise das Einschränken des Zugriffs auf Modelle mithilfe von Azure Policy und die sichere Bereitstellung mithilfe von verwalteten virtuellen Netzwerken.

Bereitstellung von Modellen für Rückschlüsse mit verwalteten Compute Services

Modelle, die für die Bereitstellung für verwaltete Compute Services verfügbar sind, können für verwaltete Azure Machine Learning-Computeressourcen für den Echtzeitrückschluss bereitgestellt werden. Für die Bereitstellung für verwaltete Compute Services müssen Sie über ein VM-Kontingent in Ihrem Azure-Abonnement für die spezifischen Produkte verfügen, die Sie für die optimale Ausführung des Modells benötigen. Einige Modelle ermöglichen Ihnen die Bereitstellung im vorübergehend freigegebenen Kontingent für das Modelltesten.

Weitere Informationen zum Bereitstellen von Modellen:

Erstellen von generativen KI-Apps mit verwalteten Compute Services

Das Feature prompt flow in Azure Machine Learning bietet eine großartige Erfahrung für die Erstellung eines Prototyps. Modelle, die mit verwalteten Compute Services bereitgestellt werden, können Sie mit dem Open Model LLM-Tool in prompt flow verwenden. Sie können auch die REST-API verwenden, die von den verwalteten Computeressourcen in beliebten LLM-Tools wie LangChain mit der Azure Machine Learning-Erweiterung verfügbar gemacht wird.

Inhaltssicherheit für Modelle, die als verwaltete Compute Services bereitgestellt werden

Der Dienst Azure KI Inhaltssicherheit ist für die Verwendung mit verwalteten Compute Services verfügbar, um verschiedene Kategorien von schädlichen Inhalten zu überprüfen, z. B. sexuelle Inhalte, Gewalt, Hass und Selbstverletzung. Sie können den Dienst auch verwenden, um auf erweiterte Bedrohungen wie die Erkennung von Jailbreak-Risiken und die Erkennung von geschütztem Textmaterial zu überprüfen.

Sie können für eine Referenzintegration in Azure KI Inhaltssicherheit für Llama 2 auf dieses Notebook verweisen. Alternativ können Sie das Tool für Inhaltssicherheit (Text) in prompt flow verwenden, um Antworten vom Modell an Azure KI Inhaltssicherheit zur Überprüfung zu übergeben. Sie werden für eine solche Verwendung separat in Rechnung gestellt, wie in Azure KI Inhaltssicherheit beschrieben.

Serverlose API (Pay-per-Token)-Abrechnung

Sie können bestimmte Modelle im Modellkatalog mit Pay-per-Token-Abrechnung bereitstellen. Diese Bereitstellungsmethode wird auch als Serverless-API bezeichnet und bietet eine Möglichkeit, die Modelle als APIs zu nutzen, ohne sie in Ihrem Abonnement zu hosten. Modelle werden in einer von Microsoft verwalteten Infrastruktur gehostet, wodurch API-basierter Zugriff auf das Modell des Modellanbieters ermöglicht wird. Der API-basierte Zugriff kann die Kosten für den Zugriff auf ein Modell dramatisch reduzieren und die Bereitstellungserfahrung vereinfachen.

Modelle, die für die Bereitstellung als serverlose APIs mit nutzungsbasierter Abrechnung verfügbar sind, werden vom Modellanbieter angeboten, aber sie werden in einer von Microsoft verwalteten Azure-Infrastruktur gehostet und über eine API zugänglich gemacht. Modellanbieter definieren die Lizenzbedingungen und legen den Preis für die Verwendung ihrer Modelle fest. Der Azure Machine Learning Service:

- Verwaltet die Hostinginfrastruktur.

- Stellt die Rückschluss-APIs zur Verfügung.

- Fungiert als Datenprozessor für die übermittelten Prompts und ausgegebenen Inhalte der über MaaS bereitgestellten Modelle.

Erfahren Sie mehr über die Datenverarbeitung für MaaS im Artikel zum Datenschutz.

Hinweis

Bei Cloud Solution Provider (CSP)-Abonnements gibt es nicht die Möglichkeit, serverlose API-Bereitstellungen (MaaS)-Modelle zu erwerben.

Abrechnung

Die Erfahrung für Ermittlung, Abonnement und Verbrauch für Modelle, die über MaaS bereitgestellt werden, befindet sich im Azure KI Foundry-Portal und im Azure Machine Learning Studio. Benutzer akzeptieren Lizenzbedingungen für die Verwendung der Modelle. Preisinformationen für den Verbrauch werden während der Bereitstellung bereitgestellt.

Modelle von Nicht-Microsoft-Anbietern werden über Azure Marketplace gemäß den Nutzungsbedingungen des kommerziellen Microsoft-Marketplace in Rechnung gestellt.

Modelle von Microsoft werden über Azure-Verbrauchseinheiten als Erstanbieter-Verbrauchsdienste in Rechnung gestellt. Wie in den Produktbedingungen beschrieben, erwerben Sie Erstanbieter-Verbrauchsdienste mithilfe von Azure-Verbrauchseinheiten, sie unterliegen jedoch nicht den Azure-Dienstbestimmungen. Die Verwendung dieser Modelle unterliegt den bereitgestellten Lizenzbedingungen.

Optimierung von Modellen

Bestimmte Modelle unterstützen auch Feinabstimmungen. Für diese Modelle können Sie verwaltetes Compute (Vorschau) oder die serverlose API-Feinabstimmung nutzen, um die Modelle mithilfe bereitgestellter Daten anzupassen. Weitere Informationen finden Sie in der Feinabstimmungsübersicht.

RAG mit Modellen, die als serverlose APIs bereitgestellt werden

Im Azure KI Foundry-Portal können Sie Vektorindizes und die Abruf-erweiterte Generierung (Retrieval Augmented Generation, RAG) verwenden. Sie können Modelle verwenden, die über serverlose APIs bereitgestellt werden können, um Einbettungen und Rückschlüsse basierend auf benutzerdefinierten Daten zu generieren. Diese Einbettungen und Rückschlüsse können dann Antworten generieren, die spezifisch für Ihren Anwendungsfall sind. Weitere Informationen finden Sie unter Erstellen und Nutzen von Vektorindizes im Azure KI Foundry-Portal.

Regionale Verfügbarkeit von Angeboten und Modellen

Die Pay-per-Token-Abrechnung ist nur für Benutzer verfügbar, deren Azure-Abonnement zu einem Abrechnungskonto in einem Land oder einer Region gehört, in dem der Modellanbieter das Angebot verfügbar gemacht hat. Wenn das Angebot in der relevanten Region verfügbar ist, müssen die Benutzer über eine Projektressource in der Azure-Region verfügen, in der das Modell für die Bereitstellung oder Optimierung verfügbar ist. Ausführliche Informationen finden Sie unter Regionale Verfügbarkeit für Modelle an serverlosen API-Endpunkten | Azure KI Foundry.

Inhaltssicherheit für Modelle, die über die serverlose APIs bereitgestellt werden

Für Sprachmodelle, die über serverlose APIs bereitgestellt werden, implementiert Azure KI eine Standardkonfiguration für Textmoderationsfilter von Azure KI Inhaltssicherheit, welche schädliche Inhalte wie Hass, Selbstverletzung, sexuelle und gewalttätige Inhalte entdecken. Weitere Informationen zur Inhaltsfilterung (Vorschau) finden Sie unter Schadenkategorien in Azure KI Inhaltssicherheit.

Tipp

Die Inhaltsfilterung (Vorschau) ist für bestimmte Modelltypen, die über serverlose APIs bereitgestellt werden, nicht verfügbar. Zu diesen Modelltypen gehören Einbettungsmodelle und Zeitreihenmodelle.

Die Inhaltsfilterung (Vorschau) erfolgt synchron, während der Dienst Prompts zur Generierung von Inhalten verarbeitet. Möglicherweise werden Sie gemäß den Azure KI Inhaltssicherheit-Preisen für diese Verwendung separat in Rechnung gestellt. Sie können die Inhaltsfilterung (Vorschau) für einzelne serverlose Endpunkte deaktivieren, entweder:

- Zum Zeitpunkt der ersten Bereitstellung eines Sprachmodells

- Später, indem Sie den Umschalter für die Inhaltsfilterung auf der Seite mit den Bereitstellungsdetails verwenden

Angenommen, Sie entscheiden sich für die Verwendung einer anderen API als der Azure KI Model Inference-API, um mit einem Modell zu arbeiten, das über eine serverlose API bereitgestellt wird. In einer solchen Situation ist die Inhaltsfilterung (Vorschau) nicht aktiviert, es sei denn, Sie implementieren sie separat mithilfe von Azure KI Inhaltssicherheit.

Erste Schritte mit Azure KI Inhaltssicherheit finden Sie im Schnellstart: Analysieren von Textinhalten. Wenn Sie beim Arbeiten mit Modellen, die über serverlose APIs bereitgestellt werden, keine Inhaltsfilterung (Vorschau) verwenden, besteht ein höheres Risiko, dass Benutzer schädlichen Inhalten ausgesetzt werden.

Netzwerkisolation für Modelle, die über serverlose APIs bereitgestellt werden

Endpunkte für Modelle, die als serverlose APIs bereitgestellt werden, folgen der Flageinstellung für den öffentlichen Netzwerkzugriff des Azure AI Foundry-Hubs mit dem Projekt mit der Bereitstellung. Um Ihren serverlosen API-Endpunkt zu schützen, deaktivieren Sie das Flag für den Zugriff aus dem öffentlichen Netzwerk in Ihrem Azure AI Foundry-Hub. Sie können eingehende Kommunikation von einem Client zu Ihrem Endpunkt sichern, indem Sie einen privaten Endpunkt für den Hub verwenden.

So legen Sie das Flag für den öffentlichen Netzwerkzugriff für den Azure KI Foundry-Hub fest:

- Öffnen Sie das Azure-Portal.

- Suchen Sie nach der Ressourcengruppe, zu welcher der Hub gehört, und wählen Sie Ihren Azure KI Foundry-Hub aus den Ressourcen aus, die für diese Ressourcengruppe aufgeführt sind.

- Wechseln Sie auf der Hubübersicht im linken Bereich zu Einstellungen>Netztechnologie.

- Auf der Registerkarte Öffentlicher Zugriff können Sie Einstellungen für das Flag für den öffentlichen Netzwerkzugriff konfigurieren.

- Speichern Sie die Änderungen. Es kann bis zu fünf Minuten dauern, bis Ihre Änderungen verteilt sind.

Einschränkungen

Wenn Sie einen Azure AI Foundry-Hub mit einem privaten Endpunkt haben, der vor dem 11. Juli 2024 erstellt wurde, folgen serverlose API-Endpunkte, die zu Projekten in diesem Hub hinzugefügt wurden, nicht der Netzwerkkonfiguration des Hubs. Stattdessen müssen Sie einen neuen privaten Endpunkt für den Hub erstellen und neue serverlose API-Bereitstellungen im Projekt erstellen, damit die neuen Bereitstellungen der Netzwerkkonfiguration des Hubs folgen können.

Wenn Sie einen Azure AI Foundry-Hub mit MaaS-Bereitstellungen haben, die vor dem 11. Juli 2024 erstellt wurden, und Sie einen privaten Endpunkt auf diesem Hub aktivieren, folgen die vorhandenen serverlosen API-Bereitstellungen nicht der Netzwerkkonfiguration des Hubs. Damit serverlose API-Bereitstellungen im Hub der Netzwerkkonfiguration des Hubs folgen können, müssen Sie die Bereitstellungen erneut erstellen.

Derzeit ist der Support für Azure OpenAI On Your Data für serverlose API-Bereitstellungen in privaten Hubs nicht verfügbar, da bei privaten Hubs das Flag für den Zugriff aus öffentlichen Netzwerken deaktiviert ist.

Jede Netzwerkkonfigurationsänderung (z. B. das Aktivieren oder Deaktivieren des Flags für den öffentlichen Netzwerkzugriff) kann bis zu fünf Minuten dauern, bis sie verteilt ist.