Übersicht über Copilot und ASD Blueprint

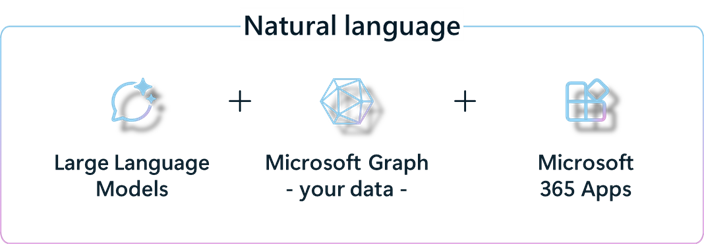

Copilot für Microsoft 365 bietet Benutzern einen generativen KI-gestützten Assistenten, der in natürlicher Sprache interagiert, um Ihren Workflow zu optimieren. Beispiele hierfür sind das Zusammenfassen von E-Mails und Dokumenten, das Bereitstellen von Besprechungszusammenfassungen, das Erstellen neuer Inhalte und das Beantworten von Fragen, die direkt in die alltäglichen Microsoft 365-Anwendungen (Office) integriert sind. Copilot bietet eine Schnittstelle in natürlicher Sprache für einen anspruchsvollen KI-Assistenten in Office.

Eine IRAP-Bewertung (Protected Infosec Registered Assessors Program) von Microsoft 365 wurde im März 2024 im Microsoft Service Trust Portal veröffentlicht und umfasst Copilot für Microsoft 365 in den Bereich der bewerteten Dienste. Dies ist die höchste Sicherheitsbewertungsstufe, die für einen öffentlichen Clouddienst in Australien gilt. Wie bei jedem neuen Dienst, der in einer sensiblen Umgebung bereitgestellt wird, erfordert die Einführung von Copilot jedoch eine bestimmte Konfiguration. Dieser Leitfaden zur Konfigurationsplanung befasst sich mit den speziellen Überlegungen, die für die erfolgreiche Bereitstellung von Copilot für Microsoft 365 innerhalb eines sensiblen betriebsbezogenen Frameworks erforderlich sind. Es bietet einen umfassenden Überblick über die Dienstarchitektur und wichtige Integrationsüberlegungen für eine sensible Umgebung. Dieser Leitfaden setzt den Zugriff auf copilot for Microsoft 365-Abonnementlizenzierung und Microsoft 365 Enterprise E5 voraus, in Übereinstimmung mit dem Leitfaden zur Konfiguration der Australian Signals Directorate (ASD) blueprint for Secure Cloud für Microsoft 365.

| Copilot ist... | Copilot ist nicht... |

|---|---|

| Ihren KI-Assistenten | Ihre KI-Ersetzung |

| von Menschen kontrolliert | einen unabhängigen Kollegen |

| Steigern Ihrer Produktivität | Beseitigung Ihrer Rolle |

| Erstellen von Inhalten | Auswählen von "Senden" oder "Speichern" |

| Hilfe bei der Suche nach Antworten | Automatisierte Entscheidungsfindung |

| Sofort einsatzbereites SaaS | Eine App-Entwicklungskomponente |

Dienstarchitektur

Wenn Sie die Integration von Copilot für Microsoft 365 in Betracht ziehen, ist es nützlich, Copilot für Microsoft 365 im Kontext des Microsoft AI Shared Responsibility-Modells zu bewerten. Dieser Ansatz spiegelt die Überlegungen für andere Clouddienste in den Modellen Infrastructure, Platform und Software-as-a-Service wieder. KI-Dienste unterscheiden sich ähnlich, und die gebührenden Überlegungen und der Fokus eines Verbrauchers solcher Dienste sollten auf ähnliche Weise informiert werden. Kunden wird empfohlen, sich mit dem Microsoft AI Shared Responsibility-Modell vertraut zu machen.

Die spezifische Architektur von Copilot für Microsoft 365 kann in diesem Kontext leichter verstanden werden, da Copilot für Microsoft 365 ein SaaS-Produkt (Software-as-a-Service) ist, das nahtlos in Microsoft 365 eingebettet ist.

Verantwortlichkeiten des Kunden

Die fünf Bereiche des KI-Modells für gemeinsame Verantwortung, die bei der Implementierung von SaaS-Anwendungen wie Copilot für Microsoft 365 zu berücksichtigen sind, werden in diesem Artikel ausführlich beschrieben. Kunden wird empfohlen, den Konfigurationsleitfaden in diesem Dokument zu folgen und darüber nachzudenken, wie sich ihre internen Richtlinien und Praktiken auf diese Verantwortungsbereiche auswirken können.

Im Rahmen des KI-Modells für gemeinsame Verantwortung deckt Copilot für Microsoft 365 alle drei Verantwortungsszenarien ab:

Verantwortung des Kunden: Diese Artikel werden ausschließlich vom Kunden adressiert. Microsoft ist nicht dafür verantwortlich, diese Komponenten zu behandeln.

Microsoft-Verantwortung: Diese Elemente werden ausschließlich von Microsoft behandelt. Der Kunde ist nicht dafür verantwortlich, diese Komponenten zu behandeln.

Gemeinsame Verantwortung: Innerhalb der Elemente der gemeinsamen Verantwortung in diesem Modell sind Kunden für die Konfiguration des Diensts gemäß ihren spezifischen Anforderungen verantwortlich, während Microsoft die Integrität der Plattform sicherstellt und die vom Kunden konfigurierten Kontrollen erzwingt. Kunden sind für nicht technische Aspekte dieser Elemente verantwortlich, z. B. die Einführung und Anpassung von Richtlinien und Verfahren, das Festlegen wiederkehrender Muster & Praktiken und das Treffen von Entscheidungen über die anzuwendenden Konfigurationen.

Die Einhaltung dieser Anforderungen durch Microsoft wird durch den Microsoft 365 IRAP-Bewertungsbericht veranschaulicht, der sicherstellt, dass Copilot für Microsoft 365 innerhalb der festgelegten Datensicherheits- und Complianceparameter der Microsoft 365-Umgebung funktioniert.

Schulung und Verantwortlichkeit von Benutzern

Innerhalb des KI-Modells mit geteilter Verantwortung tragen Kunden die volle Verantwortung für die Schulung und Verantwortlichkeit von Benutzern.

Wie bei jeder neuen Technologie hilft ein effektives Training den Benutzern, generative KI in ihrer Arbeit zu verstehen und sicher anzuwenden, wodurch die Wahrscheinlichkeit von Fehlern oder unangemessenem Benutzerverhalten verringert und sichergestellt wird, dass die KI-gestützten Ausgaben für den Zweck geeignet sind.

Wichtig

Microsoft empfiehlt allen Kunden, bei der Implementierung von generativen KI-Produkten die Einführung und das Change Management zu priorisieren. Dazu gehört die Entwicklung einer umfassenden Strategie, die sicherstellt, dass Benutzer entsprechend geschult und auf die richtigen Möglichkeiten für die Nutzung von KI-Systemen trainiert werden.

Generative KI-Dienste wie Copilot für Microsoft 365 bieten erhebliche Vorteile bei der Verbesserung von Produktivität, Kreativität und Arbeitsqualität, aber sie sind nicht unfehlbar und machen Fehler. Daher ist ein menschenorientierter Ansatz, der die Autonomie des Endbenutzers anerkennt, von entscheidender Bedeutung. Kunden müssen sicherstellen, dass Die Benutzer bei der Verwendung von generativen KI-Diensten ordnungsgemäß geschult sind und sich ihrer Verantwortung bewusst sind. Diese human-zentrierte Philosophie ist integraler Bestandteil des Copilot-Modells und stellt sicher, dass Die Benutzer die Kontrolle über ihren Einsatz von KI behalten und dafür verantwortlich sind.

Es ist ebenso wichtig, dass IT-Experten, Die Verwalter des Diensts sowie leitende Stakeholder und Führungskräfte innerhalb der Organisation über die Verwendung von Copilot für Microsoft 365 informiert werden. Führungskräfte spielen eine entscheidende Rolle bei der Kommunikation der Vision für generative KI-Dienste in der gesamten Organisation und stellen sicher, dass Endbenutzer die erforderlichen Anleitungen und Coachings erhalten, um die Vorteile von Diensten zu maximieren. Dies umfasst die Formulierung der Vision für Copilot für Microsoft 365, die Erläuterung der Vorteile und die Bereitstellung geeigneter Nutzungsszenarien für ein ganzheitliches Verständnis und eine effektive Nutzung.

Wichtig

Es ist wichtig, dass das Engagement der Führung einer Organisation, die Vision voranzutreiben und Richtlinien und Praktiken innerhalb dieser Zuständigkeiten auszurichten, für eine erfolgreiche Implementierung von Copilot für Microsoft 365 gleichermaßen entscheidend ist.

Durch die Einhaltung dieser Vorgehensweisen integrieren viele Kunden effektiv generative KI, richten sie an ihren Geschäftszielen aus und steigern die Produktivität.

Weitere Informationen zum Initiieren des geeigneten Change Managements, der Einführung und der Benutzerschulung für IT-Experten finden Sie unter:

- Erste Schritte mit Copilot für Microsoft 365

- Vorbereiten Ihrer Organisation für Copilot für Microsoft 365

- Produktdokumentation

- Dehnbarkeit

Weitere Informationen zum Initiieren der geeigneten Änderungsverwaltung, Einführung und Benutzerschulung für Endbenutzer finden Sie unter:

- Produktübersicht

- Produktvideos

- Copilot Interaction Lab (erfordert Lizenz und Anmeldung)

- Einführung und Change Management

Nutzungsrichtlinie, Administratorsteuerelemente

Innerhalb des KI-Modells mit geteilter Verantwortung haben Kunden die volle Verantwortung für die Nutzungsrichtlinie und die Anwendung von Administratorsteuerelementen.

Die Festlegung einer Nutzungsrichtlinie ist eine Angelegenheit, die einzelne Organisationen im Kontext ihrer rechtlichen, vertraglichen und regulatorischen Rahmenbedingungen, eigenen Arbeitsmuster und Erwartungen der Beteiligten berücksichtigen müssen, z. B.:

- Interne Nutzungserwartungen im Vergleich zu Gästen

- Verwendung bei der Erstellung externer Kommunikation

- Akzeptanz von KI-Beteiligung an personalisierten Interaktionen

- Demografie der Beteiligten

Der Schwerpunkt dieses Konfigurationsplanungsleitfadens liegt auf Administratorsteuerelementen, die im Artikel Empfohlene Konfiguration ausführlich erläutert werden.

Identitäts-, Geräte- und Zugriffsverwaltung

Innerhalb des KI-Modells für gemeinsame Verantwortung sind Identitäts-, Geräte- und Zugriffsverwaltung eine gemeinsame Verantwortung.

Copilot für Microsoft 365 ist für die nahtlose Integration in die vorhandenen Identitäts-, Geräte- und Zugriffsverwaltungskonfigurationen in der Microsoft 365-Umgebung eines Kunden konzipiert. Dieser Leitfaden konzentriert sich auf zusätzliche Steuerelemente speziell für Copilot für Microsoft 365 oder hebt vorhandene Steuerelemente hervor, die für Organisationen relevant sind, die Copilot für Microsoft 365 implementieren.

Weitere Konfigurationsanleitungen bei der Bereitstellung einer sensiblen Microsoft 365-Umgebung finden Sie in der ASD Blueprint for Secure Cloud , die umfassende Empfehlungen und Protokolle für eine sichere Konfiguration bietet.

Datengovernance

Innerhalb des KI-Modells für gemeinsame Verantwortung ist Die Datengovernance eine gemeinsame Verantwortung. Effektive Datengovernance ist für die Verwaltung von Wissen und Informationen unerlässlich, um die Auffindbarkeit zu verbessern und die Produktivität in jeder Organisation zu steigern, die sich einer digitalen Transformation unterzogen hat. In diesem Dokument werden die wichtigsten Datengovernancemechanismen und -methoden beschrieben, die für eine erfolgreiche Implementierung von Copilot für Microsoft 365 von wesentlicher Bedeutung sind.

Weitere Informationen zur Datengovernance innerhalb des breiteren Microsoft 365-Ökosystems finden Sie unter:

KI-Plug-Ins und Datenverbindungen

Innerhalb des KI Shared Responsibility-Modells sind Plug-Ins und Datenverbindungen eine gemeinsame Verantwortung. Connectors und Plug-Ins ermöglichen Es Kunden, die Funktionen von Copilot für Microsoft 365 zu erweitern, sodass es über ihre Microsoft 365-Umgebung hinaus mit Systemen und Daten zusammenarbeiten kann. Daher müssen Kunden sowohl die Verantwortung für das Management der Risiken bei der Verwendung externer Daten und Systeme als auch die Integration selbst berücksichtigen, da dies von Microsoft entwickelt, vom Kunden entwickelt oder nicht von Microsoft stammt. Kunden sind für alle nicht von Microsoft oder benutzerdefinierten entwickelten Connectors und Plug-Ins verantwortlich.

IT-Experten sollten sich mit Den Erweiterbarkeitsoptionen und Architekturen von Copilot für Microsoft 365 vertraut machen.

Plug-Ins wie Bing unterscheiden sich von Connectors darin, dass sie in Echtzeit arbeiten, um Copilot mit neuen Fähigkeiten und Erkenntnissen zu erweitern. Eine ausführlichere Beschreibung der Plug-Ins und Connectors finden Sie im Artikel Dienstkomponenten .