Preisszenario mit Dataflow Gen2 zum Laden von 2 GB Parquet-Daten in eine Lakehouse-Tabelle

In diesem Szenario wurde Dataflow Gen2 verwendet, um 2 GB Parquet-Daten zu laden, die in Azure Data Lake Storage (ADLS) Gen2 in einer Lakehouse-Tabelle in Microsoft Fabric gespeichert sind. Wir haben die Beispieldaten „NYC Taxi – Green“ für die Parquet-Daten verwendet.

Die im folgenden Beispiel verwendeten Preise sind hypothetisch und stellen nicht die tatsächlichen genauen Preise dar. Diese Beispiele sollen nur zeigen, wie Sie die Kosten für Data Factory-Projekte in Microsoft Fabric schätzen, planen und verwalten können. Da die Preise für Fabric-Kapazitäten in jeder Region unterschiedlich sind, verwenden wir nutzungsbasierte Preise für eine Fabric-Kapazität in USA, Westen 2 (einer typischen Azure-Region) in Höhe von 0,18 $ pro CU und Stunde. Weitere Preisoptionen für Fabric-Kapazitäten finden Sie unter Microsoft Fabric – Preise.

Konfiguration

Um dieses Szenario zu realisieren, müssen Sie einen Dataflow mit den folgenden Schritten erstellen:

- Initialisieren von Dataflow: Abrufen von 2 GB Parquet-Daten aus ADLS Gen2-Speicherkonto.

- Konfigurieren der Power Query:

- Navigieren Sie zu Power Query.

- Stellen Sie sicher, dass die Option zum Staging der Abfrage aktiviert ist.

- Fahren Sie fort, um die Parquet-Dateien zu kombinieren.

- Datentransformation:

- Stufen Sie Kopfzeilen zur Übersichtlichkeit höher.

- Entfernen Sie überflüssige Spalten.

- Passen Sie die Spaltendatentypen nach Bedarf an.

- Definieren des Ausgabedatenziels:

- Konfigurieren Sie Lakehouse als Datenausgabeziel.

- In diesem Beispiel wurde ein Lakehouse in Fabric erstellt und verwendet.

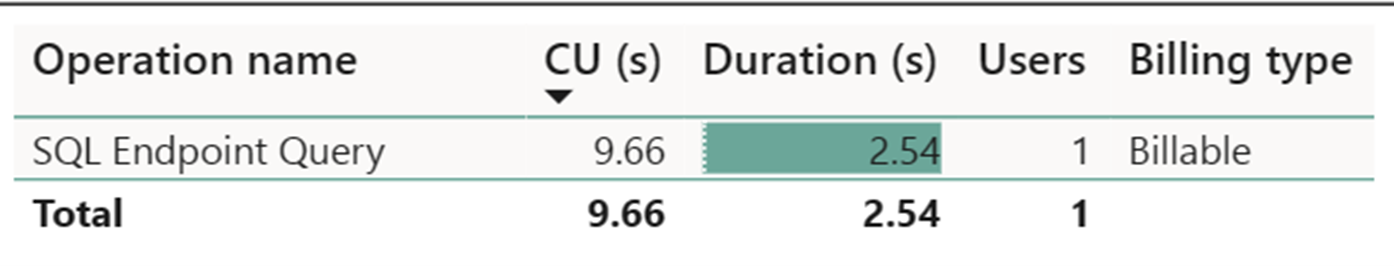

Kostenschätzung mithilfe der Fabric-Metrik-App

Für die Verbrauchseinheit vom Typ „Hohe Skalierung für Dataflow-Computeressourcen“ wurde eine vernachlässigbare Aktivität aufgezeichnet. Für die Verbrauchseinheit vom Typ „Standard-Compute“ für Dataflow Gen2-Aktualisierungsvorgänge verbraucht 112.098,540 Compute-Einheiten (Compute Units, CUs). Es ist wichtig zu beachten, dass andere Vorgänge, einschließlich Warehouse-Abfragen, SQL-Endpunktabfragen und bedarfsgesteuerte Dataset-Aktualisierungen, detaillierte Aspekte der Dataflow Gen2-Implementierung darstellen, die derzeit transparent und für ihre jeweiligen Vorgänge erforderlich sind. Diese Vorgänge werden jedoch in zukünftigen Updates verborgen und sollten bei der Schätzung der Kosten für Dataflow Gen2 ignoriert werden.

Hinweis

Obwohl die tatsächliche Ausführungsdauer als Metrik gemeldet wird, ist sie für die Berechnung der effektiven CU-Stunden mit der Fabric-Metrik-App nicht relevant, da die ebenfalls gemeldete CU-Sekunden-Metrik die Dauer bereits berücksichtigt.

| Metrik | Compute Standard | High Scale Compute |

|---|---|---|

| CU-Sekunden insgesamt | 112.098,54 CU-Sekunden | 0 CU-Sekunden |

| Effektiv berechnete CU-Stunden | 112.098,54 / (60 · 60) = 31,14 CU-Stunden | 0 / (60*60) = 0 CU-Stunden |

Gesamtlaufkosten bei 0,18 USD/CU-Stunde = (31,14 CU-Stunden) · (0,18 USD/CU-Stunde) ~= 5,60 USD