Opzioni per ottenere i dati in Fabric Lakehouse

L'esperienza di recupero dei dati copre tutti gli scenari utente per l'inserimento dei dati nel lakehouse, ad esempio:

- Connessione a SQL Server esistente e la copia dei dati nella tabella Delta del lakehouse.

- Caricamento di file dal computer.

- Copia e unione di più tabelle da altri lakehouse in una nuova tabella Delta.

- Connessione a un'origine di streaming per atterrare i dati in un lakehouse.

- Riferimento ai dati senza copiarli da altri lakehouse interni o da origini esterne.

Modi diversi per caricare i dati in un lakehouse

In Microsoft Fabric è possibile ottenere dati in un lakehouse in diversi modi:

- Caricamento di file dal computer locale

- Eseguire uno strumento di copia nelle pipeline

- Configurare un flusso di dati

- Librerie Apache Spark nel codice del notebook

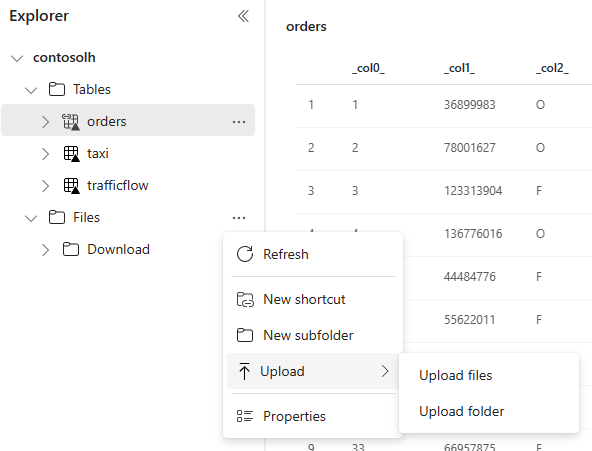

Caricamento file locale

È anche possibile caricare i dati archiviati nel computer locale. È possibile farlo direttamente in Lakehouse Explorer.

Strumento di copia nelle pipeline

Lo strumento Copia è una soluzione altamente scalabile Integrazione dei dati che consente di connettersi a origini dati diverse e caricare i dati in formato originale o convertirli in una tabella Delta. Lo strumento di copia fa parte delle attività delle pipeline che è possibile modificare in diversi modi, ad esempio la pianificazione o l'attivazione in base a un evento. Per altre informazioni, vedere Come copiare i dati usando l'attività di copia.

Flussi di dati

Per gli utenti che hanno familiarità con i flussi di dati di Power BI, lo stesso strumento è disponibile per caricare i dati nel lakehouse. È possibile accedervi rapidamente dall'opzione "Recupera dati" di Lakehouse Explorer e caricare i dati da oltre 200 connettori. Per altre informazioni, vedere Avvio rapido: Creare il primo flusso di dati per ottenere e trasformare i dati.

Codice del notebook

È possibile usare le librerie Spark disponibili per connettersi direttamente a un'origine dati, caricare i dati in un frame di dati e quindi salvarli in una lakehouse. Questo metodo è il modo più aperto per caricare i dati nella lakehouse che il codice utente gestisce completamente.

Nota

Le tabelle Delta esterne create con il codice Spark non saranno visibili a un endpoint di analisi SQL. Usare i collegamenti nello spazio tabella per rendere visibili le tabelle Delta esterne per un endpoint di analisi SQL.

Considerazioni sulla scelta dell'approccio per caricare i dati

| Caso d'uso | Consiglio |

|---|---|

| Caricamento di file di piccole dimensioni dal computer locale | Usare il caricamento di file locali |

| Dati di piccole dimensioni o connettore specifico | Usare flussi di dati |

| Origine dati di grandi dimensioni | Usare lo strumento copia nelle pipeline |

| Trasformazioni complesse dei dati | Usare il codice del notebook |