Confluent Cloud Kafka をリアルタイム ハブ (プレビュー)のソースとして追加する

この記事では、Fabric リアルタイム ハブで Confluent Cloud Kafka をイベント ソースとして追加する方法について説明します。

Note

リアルタイム ハブは現在プレビュー段階です。

前提条件

- 寄稿者以上のアクセス許可を使用して、Premiumワークスペースにアクセスします。

- Confluent Cloud Kafka クラスターと API キー。

イベントの取得エクスペリエンスを開始する

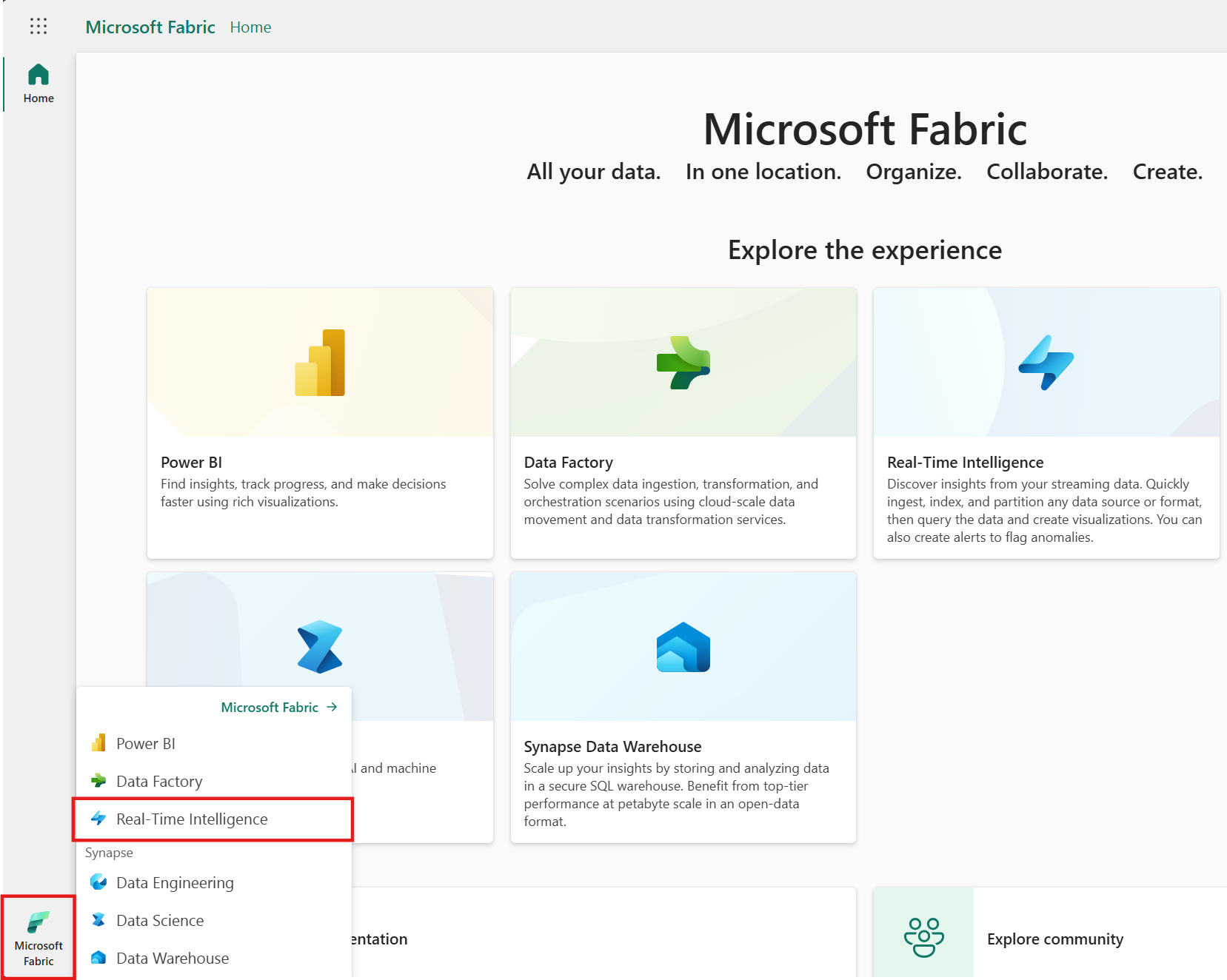

Microsoft Fabric で、[リアルタイム インテリジェンス] エクスペリエンスに切り替えます。 左側のナビゲーション バーでMicrosoft Fabricを選択し、[リアルタイム インテリジェンス]を選択します。

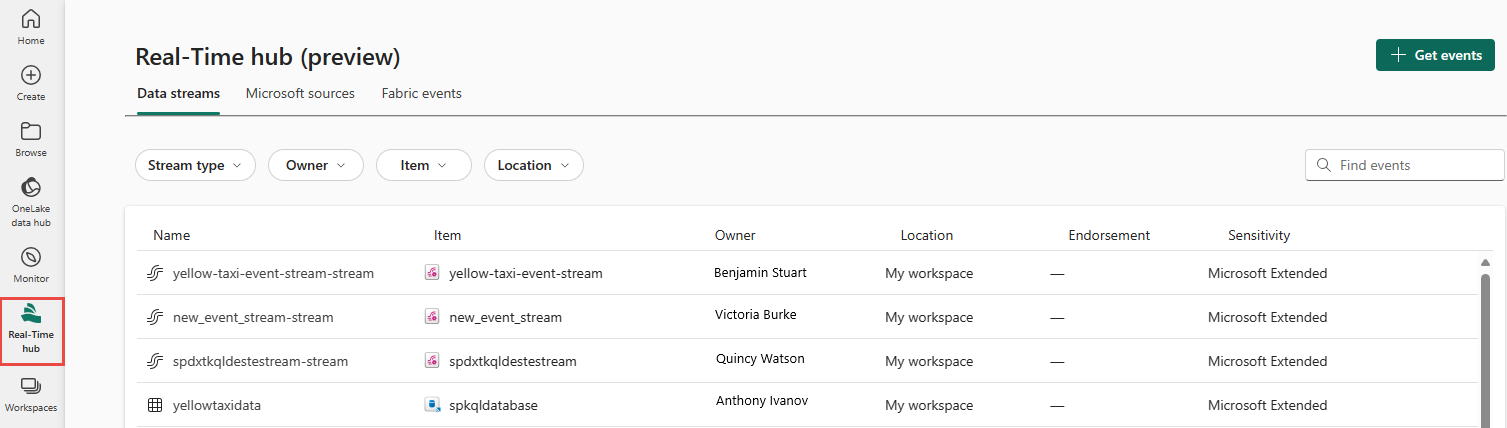

左側のナビゲーション バーで[リアルタイム ハブ]を選択します。

[リアルタイム ハブ] ページで、ページの右上隅にある [+ イベントの取得] を選択します。

Confluent Cloud Kafka をソースとして追加する

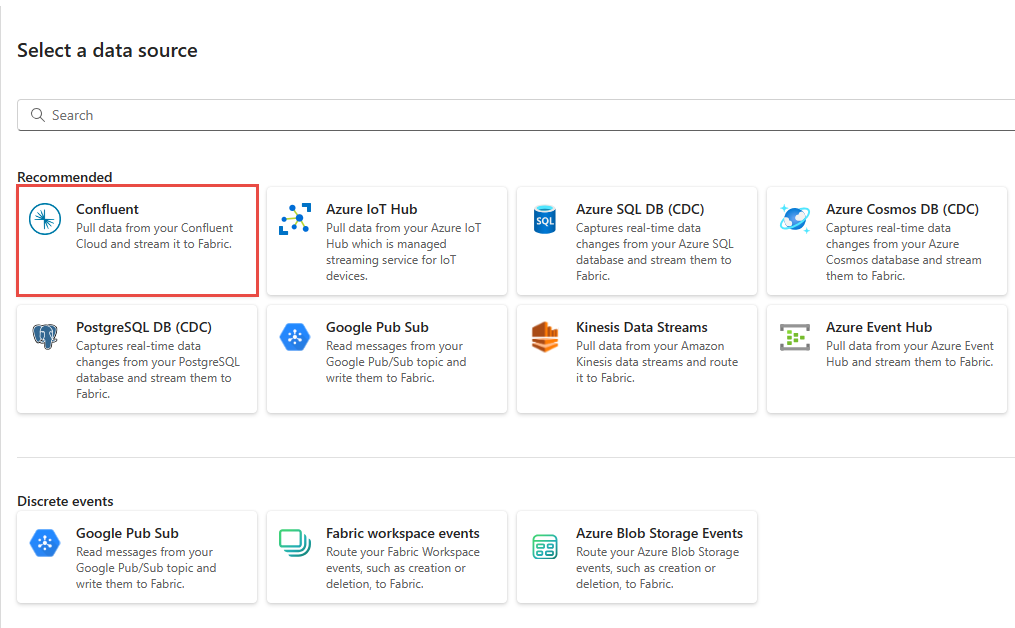

[データ ソースの選択] ページで、[Confluent] を選択します。

Confluent Cloud Kafka ソースへの接続を作成するには、[新しい接続] を選択します。

![イベントの取得ウィザードの [接続] ページで [新しい接続] リンクの選択を示すスクリーンショット。](media/add-source-confluent-kafka/new-connection-link.png)

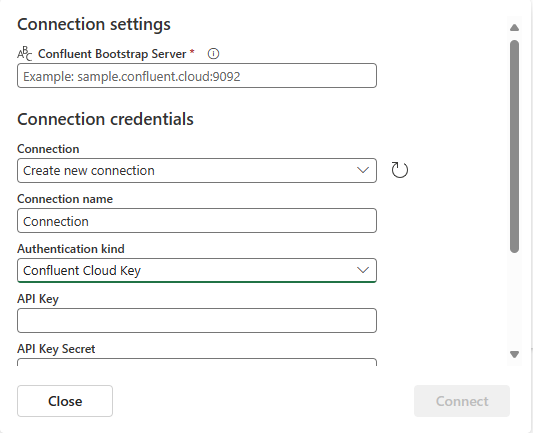

[接続設定] セクションで、「Confluent Bootstrap Server」と入力します。 Confluent Cloud のホーム ページに移動し、[クラスター 設定] を選択し、アドレスをブートストラップ サーバーにコピーします。

[接続資格情報] セクションで、Confluent クラスターへの既存の接続がある場合は、[接続] のドロップダウン リストから選択します。 そうでない場合は、次の手順に従います。

- 接続名 には、接続の名前を入力します。

- [認証の種類] で、[Confluent クラウド キー] が選択されていることを確認します。

- API キーと API キー シークレットの場合:

Confluent クラウドに移動します。

サイド メニューで、[API キー] を選択します。

[追加] ボタンを選択すると、新しいルールが作成されます。

API キーとシークレットをコピーしておきます。

これらの値を [API キー] フィールドと [API キー シークレット] フィールドに貼り付けます。

接続を選択します

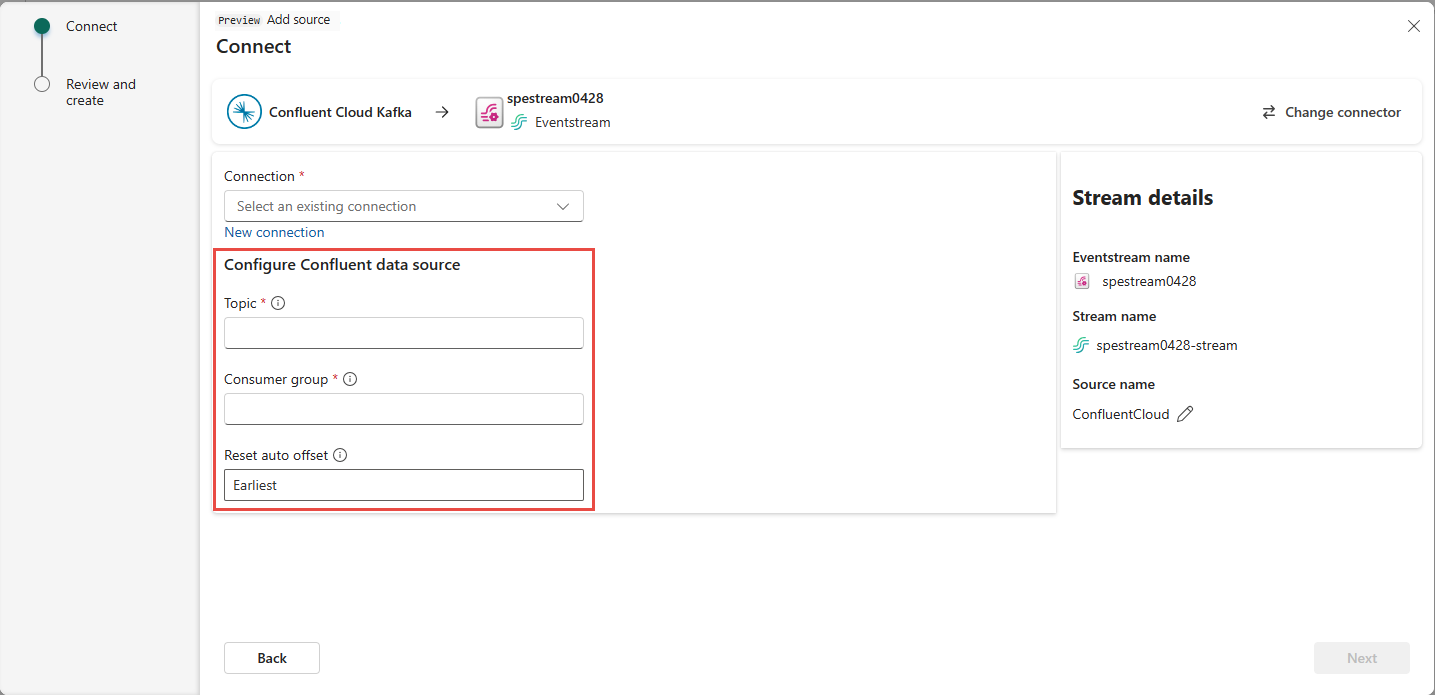

スクロールして、ページの [Confluent データ ソースの構成] セクションを表示します。 Confluent データ ソースの構成を完了するための情報を入力します。

- [トピック] に、Confluent Cloud のトピック名を入力します。 Confluent Cloud コンソールでトピックを作成または管理できます。

- コンシューマー グループの場合は、Confluent クラウドのコンシューマー グループを入力します。 Confluent Cloud クラスターからイベントを取得するための専用のコンシューマー グループが用意されています。

- [自動オフセットのリセット] 設定で、次のいずれかの値を選択します。

最も古い – Confluent クラスターから使用可能な最も古いデータ

最新 – 利用可能な最新のデータ

なし – オフセットを自動的に設定しません。

右側のペインの [ストリームの詳細] セクションで、次の手順を実行します。

接続を保存するワークスペースを選択します。

自動的に作成されるEventstreamの名前を入力します。

リアルタイム ハブのストリームの名前が自動的に生成されます。

![Confluent 接続設定ページの [ストリームの詳細] セクションが表示された、右側のウィンドウを示すスクリーンショット。](media/add-source-confluent-kafka/stream-details.png)

[次へ] を選択します。

表示された [確認と作成] タブで概要を確認し、[ソースを作成] を選びます。

データ ストリームの詳細を表示する

[確認と作成] ページで、[イベントストリームを開く] を選択すると、ウィザードに、作成されたイベントストリームが、選択した Confluent Cloud Kafka ソースと共に開きます。 ページの下部の [閉じる] をクリックしてウィザードを終了します。

リアルタイム ハブで、リアルタイム ハブの [データ ストリーム] タブに切り替えます。 ページを最新の情報に更新します。 作成されたデータ ストリームが表示されます。

詳細な手順については、「Fabric リアルタイム ハブでのデータ ストリームの詳細の表示」を参照してください。

関連するコンテンツ

データ ストリームの使用について詳しくは、次の記事を参照してください。

![リアルタイム ハブの [イベントの取得] ボタンの選択を示すスクリーンショット。](includes/media/launch-get-events-experience/get-events-button.png)