Migrar seus dados do QnA Maker para o OpenAI do Azure

O QnA Maker foi desenvolvido para ser um serviço de NLP (processamento de linguagem natural) baseado em nuvem que permite criar uma camada de conversa natural sobre seus dados. Esse serviço está sendo desativado, tendo sido substituído por respostas às perguntas personalizadas. Os runtimes de IA, no entanto, estão evoluindo devido ao desenvolvimento de Grandes Modelos de Linguagem (LLMs), como GPT-35-Turbo e GPT-4 oferecidos pelo OpenAI do Azure, que abordam muitos casos de uso baseados em chat. Use esse artigo para saber como migrar seus projetos existentes do QnA Maker para o OpenAI do Azure.

Pré-requisitos

- Um projeto do QnA Maker.

- Um recurso existente do OpenAI do Azure. Caso você ainda não tenha um recurso do OpenAI do Azure, crie um e implante um modelo.

- Verifique se você foi atribuído pelo menos à função de Colaborador do OpenAI de Serviços Cognitivos para o recurso do OpenAI do Azure.

Migrar para o OpenAI do Azure

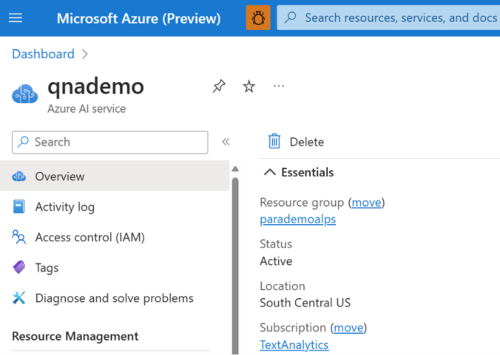

Faça logon no portal do Azure e navegue até um projeto existente do QnA Maker. Em seguida, selecione-o para abrir a seção Visão geral.

Verifique se o projeto do QnA Maker selecionado é aquele que você deseja migrar, incluindo sua assinatura do Azure e grupo de recursos.

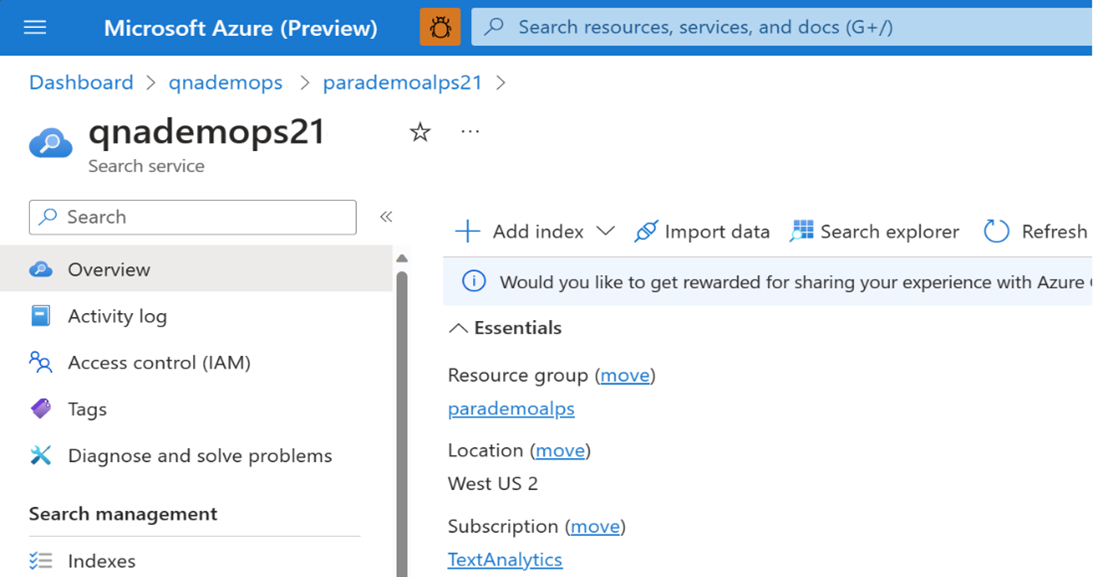

Vá para o grupo de recursos associado e filtre os recursos pelo serviço de pesquisa para localizar o serviço Cognitive Search associado.

Selecione o serviço de pesquisa e abra a seção Visão geral. Anote as informações, como o nome do recurso, a assinatura e a localização do recurso do Azure Search. Você precisará dessas informações ao migrar para o OpenAI do Azure.

Navegue até a seção Gerenciamento de pesquisa>Índices no menu à esquerda e observe o índice que você deseja migrar para o OpenAI do Azure.

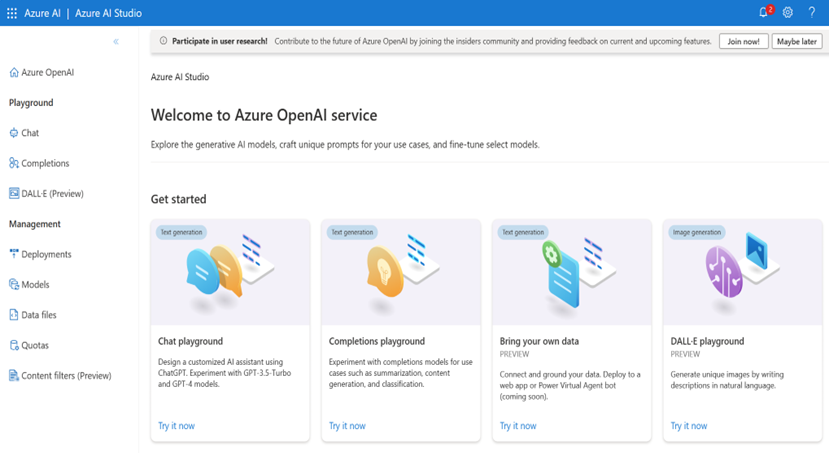

Acesse o Estúdio do OpenAI do Azure e selecione Trazer seus próprios dados.

Você também pode selecionar Playground de chat e, em seguida, selecionar Adicionar seus dados.

No painel exibido, selecione Azure Cognitive Search em Selecionar ou adicionar fonte de dados. Isso atualizará a tela com as opções de Mapeamento de campo de dados que dependem da sua fonte de dados. Selecione a assinatura, o serviço Pesquisa de IA do Azure e o índice da Pesquisa de IA do Azure associados ao seu projeto do QnA Maker. Selecione a confirmação de que a conexão gerará uso em sua conta. Em seguida, selecione Avançar.

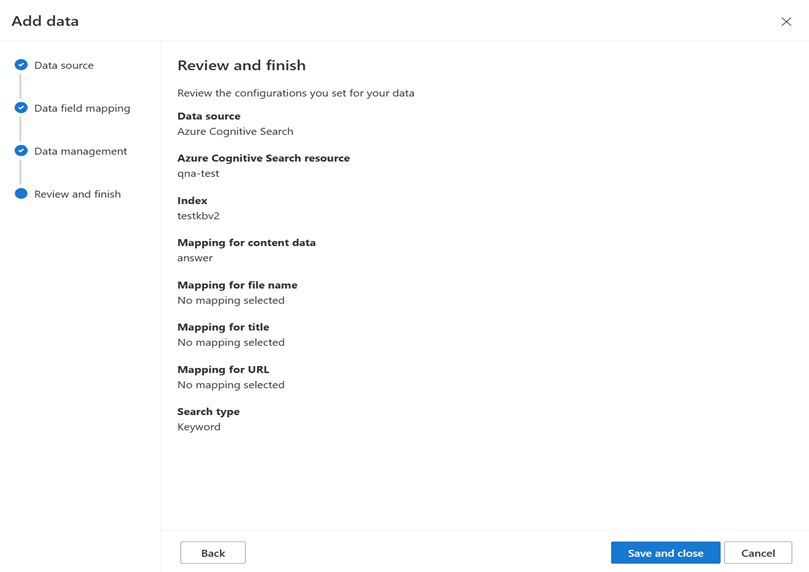

Na tela Mapeamento de campo de dados de índice, selecione a resposta para o campo Dados de conteúdo. Os outros campos, como Nome do arquivo, Título e URL, são opcionais, dependendo da natureza da sua fonte de dados.

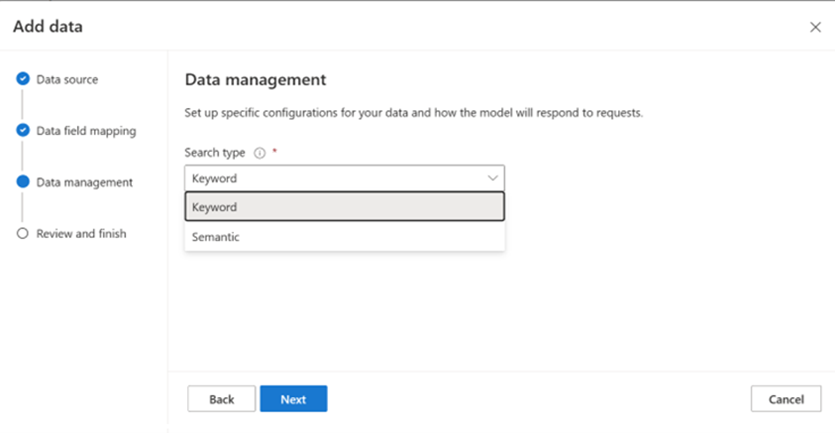

Selecione Avançar. Selecione um tipo de pesquisa no menu suspenso. Você pode escolher Palavra-chave ou Semântica. A pesquisa semântica requer uma configuração de pesquisa semântica existente, que pode ou não estar disponível para o seu projeto.

Revise as informações fornecidas e selecione Salvar e fechar.

Sua fonte de dados foi adicionada. Selecione o nome da implantação de modelo na guia Configuração>Implantação no menu à direita.

Agora você pode começar a explorar os recursos do OpenAI do Azure com uma abordagem sem código por meio do playground de chat. É apenas uma caixa de texto em que você pode enviar um prompt para gerar uma conclusão. Nesta página, você pode iterar e experimentar as funcionalidades rapidamente. Você também pode iniciar um aplicativo Web para conversar com o modelo pela web.