IA e machine learning no Databricks

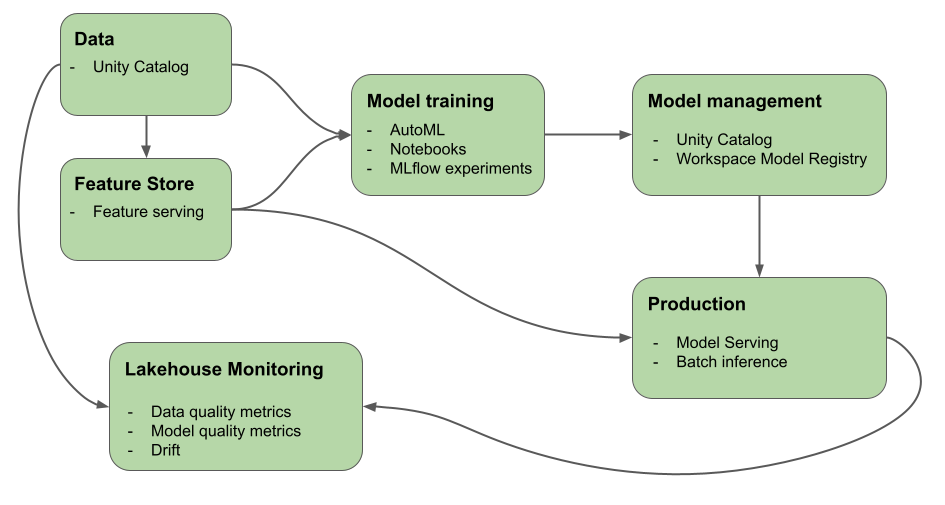

Este artigo descreve as ferramentas que o Mosaic AI (anteriormente Databricks Machine Learning) fornece para ajudá-lo a criar sistemas de IA e ML. O diagrama mostra como vários produtos na plataforma Databricks ajudam você a implementar seus fluxos de trabalho de ponta a ponta para criar e implantar sistemas de IA e ML

IA generativa em Databricks

O Mosaic AI unifica o ciclo de vida da IA desde a coleta e preparação de dados, até o desenvolvimento de modelos e LLMOps, até o atendimento e monitoramento. Os seguintes recursos são especificamente otimizados para facilitar o desenvolvimento de aplicações generativas de IA:

- Unity Catalog para governança, descoberta, controle de versão e controle de acesso para dados, recursos, modelos e funções.

- MLflow para acompanhamento do desenvolvimento de modelos.

- Modelo de IA Mosaic Servindo para implantação de LLMs. Você pode configurar um ponto de extremidade de serviço de modelo especificamente para acessar modelos de IA generativa:

- LLMs abertos de última geração usando APIs de modelo de fundação.

- Modelos de terceiros hospedados fora do Databricks. Consulte Modelos externos em Mosaic AI Model Serving.

- O Mosaic AI Vetor Search fornece um banco de dados vetorial consultável que armazena vetores de incorporação e pode ser configurado para sincronizar automaticamente com sua base de conhecimento.

- Lakehouse Monitoring para monitoramento de dados e rastreamento de modelos de previsão de qualidade e desvio usando registro automático de carga útil com tabelas de inferência.

- AI Playground para testar modelos de IA generativa a partir do seu espaço de trabalho Databricks. Você pode solicitar, comparar e ajustar configurações, como prompt do sistema e parâmetros de inferência.

- Mosaic AI Model Training (anteriormente Foundation Model Training) para personalizar um modelo de base usando seus próprios dados para otimizar seu desempenho para sua aplicação específica.

- Mosaic AI Agent Framework para criar e implantar agentes de qualidade de produção, como aplicativos de geração aumentada de recuperação (RAG).

- Mosaic AI Agent Evaluation para avaliar a qualidade, o custo e a latência de aplicações de IA generativas, incluindo aplicações e cadeias RAG.

O que é IA generativa?

A IA generativa é um tipo de inteligência artificial focada na capacidade dos computadores de usar modelos para criar conteúdo como imagens, texto, código e dados sintéticos.

As aplicações de IA generativa são construídas com base em modelos de IA generativa: grandes modelos de linguagem (LLMs) e modelos de base.

- LLMs são modelos de aprendizagem profunda que consomem e treinam conjuntos de dados massivos para se destacarem em tarefas de processamento de linguagem. Eles criam novas combinações de texto que imitam a linguagem natural com base em seus dados de treinamento.

- Modelos de IA generativa ou modelos de base são grandes modelos de ML pré-treinados com a intenção de que sejam ajustados para tarefas mais específicas de compreensão e geração de linguagem. Esses modelos são usados para discernir padrões dentro dos dados de entrada.

Depois que esses modelos completam seus processos de aprendizagem, juntos geram resultados estatisticamente prováveis quando solicitados e podem ser empregados para realizar várias tarefas, incluindo:

- Geração de imagens com base nas existentes ou utilizando o estilo de uma imagem para modificar ou criar uma nova.

- Tarefas de fala, tais como transcrição, tradução, geração de perguntas/respostas e interpretação da intenção ou significado do texto.

Importante

Embora muitos LLMs ou outros modelos de IA generativa tenham salvaguardas, eles ainda podem gerar informações prejudiciais ou imprecisas.

A IA generativa tem os seguintes padrões de design:

- Prompt Engineering: Criando prompts especializados para orientar o comportamento do LLM

- Geração aumentada de recuperação (RAG): combinando um LLM com a recuperação de conhecimento externo

- Ajuste fino: Adaptação de um LLM pré-treinado a conjuntos de dados específicos de domínios

- Pré-treinamento: Treinamento de um LLM a partir do zero

Aprendizado de máquina no Databricks

Com o Mosaic AI, uma única plataforma atende a todas as etapas do desenvolvimento e implantação de ML, desde dados brutos até tabelas de inferência que salvam todas as solicitações e respostas para um modelo atendido. Cientistas de dados, engenheiros de dados, engenheiros de ML e DevOps podem fazer seus trabalhos usando o mesmo conjunto de ferramentas e uma única fonte de verdade para os dados.

O Mosaic AI unifica a camada de dados e a plataforma de ML. Todos os ativos de dados e artefatos, como modelos e funções, podem ser descobertos e controlados em um único catálogo. O uso de uma única plataforma para dados e modelos torna possível rastrear a linhagem desde os dados brutos até o modelo de produção. O monitoramento de dados e modelos integrado salva métricas de qualidade em tabelas que também são armazenadas na plataforma, facilitando a identificação da causa raiz dos problemas de desempenho do modelo. Para obter mais informações sobre como o Databricks dá suporte ao ciclo de vida completo do ML e MLOps, consulte Fluxos de trabalho MLOps no Azure Databricks e MLOps Stacks: processo de desenvolvimento de modelo como código.

Alguns dos principais componentes da plataforma de inteligência de dados são:

| Tarefas | Componente |

|---|---|

| Governe e gerencie dados, recursos, modelos e funções. Também descoberta, versionamento e linhagem. | Catálogo Unity |

| Controlar alterações nos dados, na qualidade dos dados e na qualidade da previsão do modelo | Monitoramento Lakehouse, tabelas de inferência |

| Desenvolvimento e gerenciamento de recursos | Engenharia de recursos e serviço. |

| Preparar modelos | Mosaico AutoML, notebooks Databricks |

| Monitorizar desenvolvimento de modelos | Rastreamento de MLflow |

| Sirva modelos personalizados | Mosaico AI Model Serving. |

| Crie fluxos de trabalho automatizados e pipelines de ETL prontos para produção | Vagas de Databricks |

| Integração no Git | Pastas Databricks Git |

Aprendizagem profunda em Databricks

Configurar a infraestrutura para aplicativos de aprendizado profundo pode ser difícil. O Databricks Runtime for Machine Learning cuida disso para você, com clusters que têm versões compatíveis integradas das bibliotecas de aprendizado profundo mais comuns, como TensorFlow, PyTorch e Keras.

Os clusters Databricks Runtime ML também incluem suporte a GPU pré-configurada com drivers e bibliotecas de suporte. Ele também suporta bibliotecas como Ray para paralelizar o processamento de computação para dimensionar fluxos de trabalho de ML e aplicativos de ML.

Os clusters Databricks Runtime ML também incluem suporte a GPU pré-configurada com drivers e bibliotecas de suporte. O Mosaic AI Model Serving permite a criação de terminais de GPU escaláveis para modelos de aprendizagem profunda sem configuração extra.

Para aplicativos de aprendizado de máquina, o Databricks recomenda o uso de um cluster executando o Databricks Runtime for Machine Learning. Consulte Criar um cluster usando o Databricks Runtime ML.

Para começar a usar o aprendizado profundo no Databricks, consulte:

- Melhores práticas para aprendizagem profunda no Azure Databricks

- Aprendizagem profunda em Databricks

- Soluções de referência para aprendizagem profunda

Próximos passos

Para começar, consulte:

Para obter um fluxo de trabalho MLOps recomendado no Databricks Mosaic AI, consulte:

Para saber mais sobre os principais recursos do Databricks Mosaic AI, consulte: