Общие сведения об искусственном интеллекте

Какие продукты корпорации Майкрософт используют ИИ?

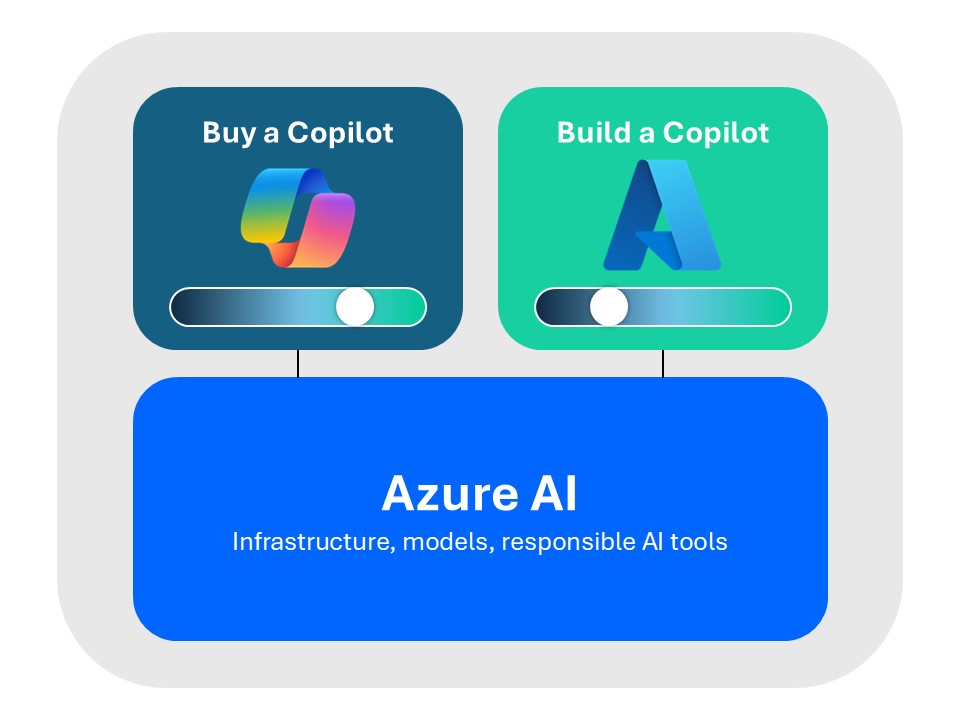

Корпорация Майкрософт предлагает разнообразные предложения по искусственному интеллекту, которые можно разделить на две группы: готовые к использованию системы генерированного ИИ, такие как Copilot, и платформы разработки ИИ, где можно создавать собственные системы генеративного ИИ.

ИИ Azure выступает в качестве общей платформы разработки, обеспечивая основу для ответственных инноваций с конфиденциальностью, безопасностью и соответствием требованиям корпоративного уровня.

Дополнительные сведения о предложениях ИИ Корпорации Майкрософт см. в следующей документации по продукту:

Как модель общей ответственности применяется к ИИ?

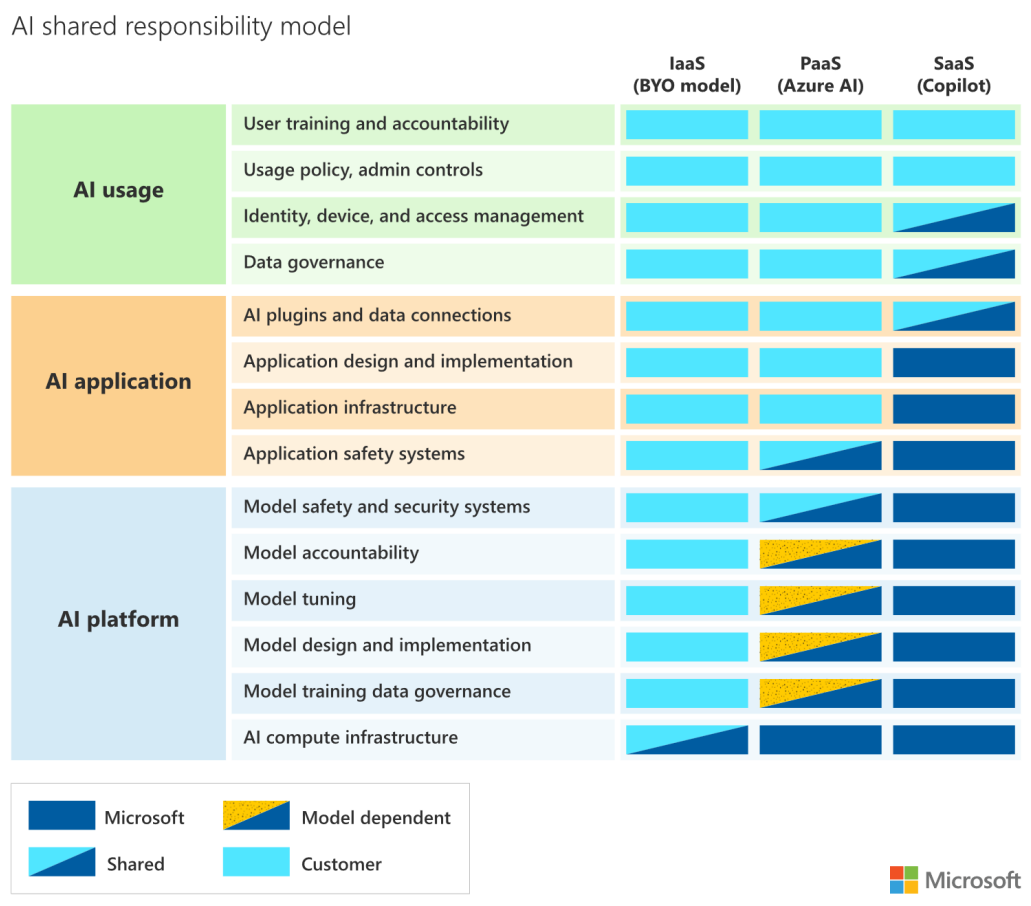

Как и в случае с другими облачными предложениями, устранение рисков ИИ является общей ответственностью корпорации Майкрософт и клиентов. В зависимости от возможностей ИИ, реализованных в вашей организации, обязанности переключаются между корпорацией Майкрософт и клиентом.

На следующей схеме показаны области ответственности между корпорацией Майкрософт и нашими клиентами в зависимости от типа развертывания.

Дополнительные сведения см. в статье Модель общей ответственности искусственного интеллекта (ИИ).

Сведения о том, как корпорация Майкрософт поддерживает клиентов в реализации их части модели общей ответственности, см. в статье Как мы поддерживаем наших клиентов в ответственном создании ИИ.

Как корпорация Майкрософт управляет разработкой систем ИИ и управлением ими?

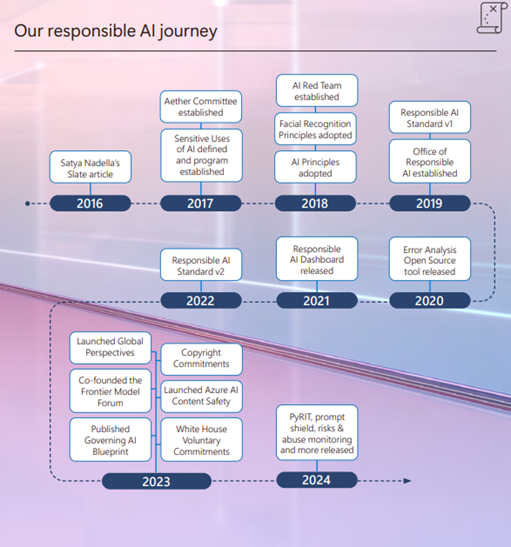

ИИ не является новым для Корпорации Майкрософт; мы уже много лет внедряем инновации в системах ИИ. Наша ответственная инициатива по ИИ стала основой наших усилий по ИИ и была инициирована выпуском статьи Сатья Наделла в 2016 году и привела к тому, что мы сегодня в практической реализации ответственного ИИ.

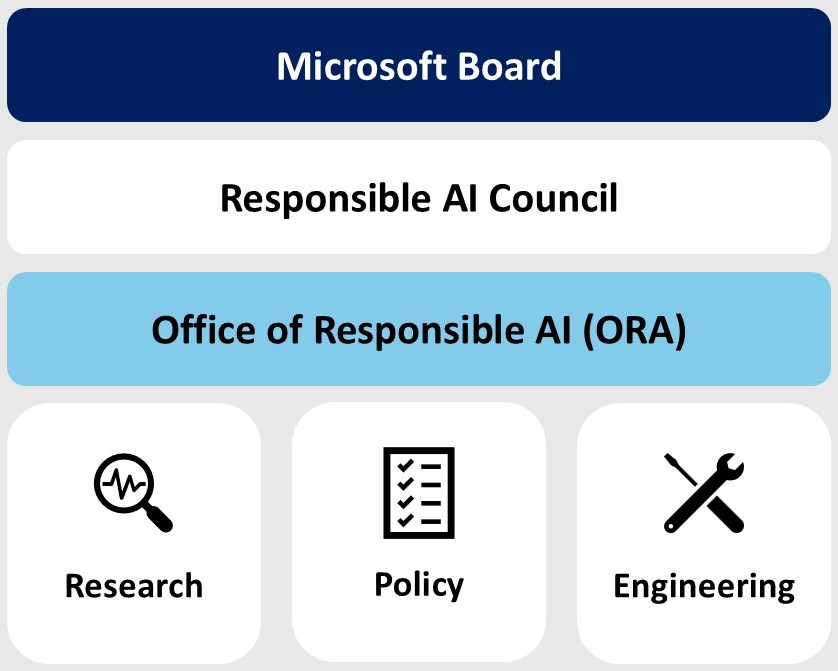

Ни одна команда или организация не несет исключительной ответственности за внедрение ответственной практики ИИ. Мы сочетаем федеративный подход снизу вверх с сильной поддержкой и контролем сверху вниз со стороны руководства компании, чтобы подпитывать нашу политику, управление и процессы. Специалисты по исследованиям, политике и инжинирингу объединяют свой опыт и сотрудничают над передовыми методиками, чтобы обеспечить выполнение наших собственных обязательств, одновременно поддерживая наших клиентов и партнеров.

- Доска Майкрософт. Управление ответственным ИИ начинается с генерального директора Сатьи Наделла и каскада в команде руководителей высшего звена и всей корпорации Майкрософт. Комитет по окружающей среде, социальной и общественной политике Совета директоров обеспечивает контроль и руководство по ответственным политикам и программам ИИ.

- Ответственный совет по ИИ. Под руководством вице-председателя и президента Брэда Смита и директора по технологиям Кевина Скотта, Совет по ИИ предоставляет форум для бизнес-лидеров и представителей исследований, политики и инженерии, чтобы регулярно решать самые большие проблемы, связанные с ИИ, и стимулировать прогресс в наших ответственных политиках и процессах ИИ.

- Управление по ответственному использованию ИИ (ORA): компании ORA поручено реализовать принципы ответственного ИИ на практике, которые они выполняют с помощью пяти ключевых функций. ORA задает внутренние политики компании, определяет структуры управления, предоставляет ресурсы для внедрения методов ИИ, проверяет конфиденциальные варианты использования и помогает формировать общедоступную политику в отношении ИИ.

- Исследования. Исследователи в Комитете по этике и эффектам ИИ в области инженерии и исследований (Aether), исследованиях Майкрософт и инженерных командах поддерживают ответственную программу ИИ на переднем крае проблем, используя руководство в области мышления.

- Политика. ORA сотрудничает с заинтересованными лицами и группами политики по всей компании для разработки политик и методик для поддержки принципов ИИ при создании приложений ИИ.

- Проектирование. Команды разработчиков создают платформы, приложения и инструменты ИИ. Они предоставляют обратную связь, чтобы убедиться, что политики и методики технически оправданы, внедряют новые методики и новые технологии, а также масштабируют ответственные методы ИИ во всей компании.

Какие принципы лежат в основе программы RAI Корпорации Майкрософт?

Корпорация Майкрософт разработала шесть принципов, посвященных человеку, чтобы способствовать формированию культуры осведомленности, обучения и инноваций по ответственным темам ИИ. Эти шесть принципов ИИ лежат в основе программы RAI Корпорации Майкрософт, и политики, разрабатываемые ORA.

Дополнительные сведения о принципах ответственного ИИ см. в статье Ответственное использование ИИ.

Как корпорация Майкрософт реализует политики, определенные ORA?

Стандарт ответственного ИИ (стандарт RAI) является результатом долгосрочных усилий по созданию критериев разработки продуктов и управления рисками для систем ИИ. Он применяет принципы RAI, определяя цели, требования и методики для всех систем ИИ, разработанных корпорацией Майкрософт.

- Goals. Определение того, что означает соблюдение принципов ИИ

- Требования. Определите, как мы должны поддерживать принципы ИИ

- Практические методики: вспомогательные средства, помогающие удовлетворить требования

Main движущей силой в стандарте RAI является оценка влияния, где команда разработчиков должна документировать результаты для каждого требования к цели. Для целей обеспечения конфиденциальности & безопасности и инклюзивности стандарт RAI указывает, что требование соответствует существующим программам конфиденциальности, безопасности и специальных возможностей, которые уже существуют в корпорации Майкрософт, и соблюдать все рекомендации по искусственному интеллекту, которые они могут иметь.

Полный стандарт RAI можно найти в документации по общим требованиям Стандарта ответственного ИИ Майкрософт.