Förstå kerneln

Kärnan är den centrala komponenten i semantisk kernel. Kärnan är som enklast en container för beroendeinmatning som hanterar alla tjänster och plugin-program som krävs för att köra AI-programmet. Om du tillhandahåller alla dina tjänster och plugin-program till kerneln används de sömlöst av AI:n efter behov.

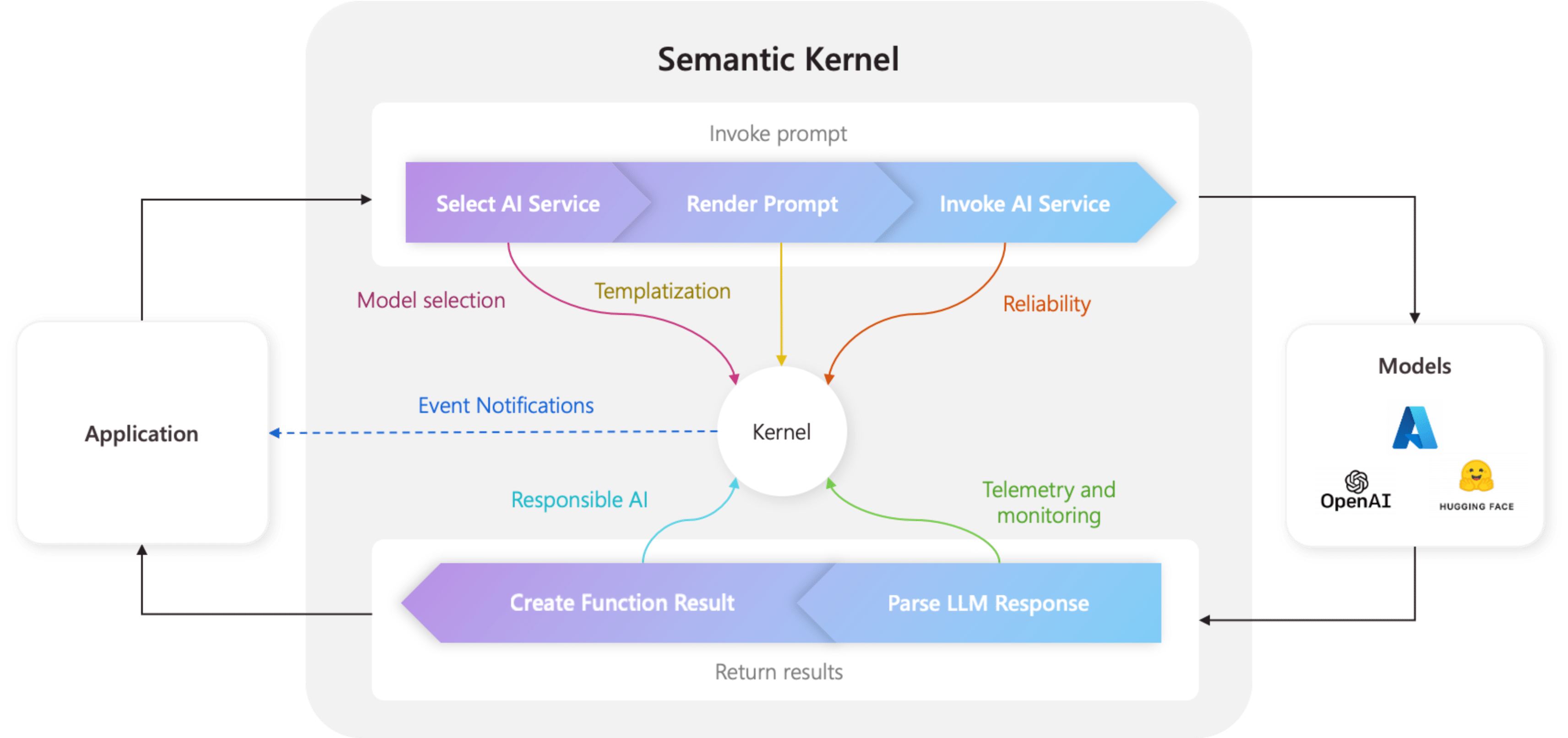

Kerneln är i mitten

Eftersom kerneln har alla tjänster och plugin-program som krävs för att köra både intern kod och AI-tjänster används den av nästan alla komponenter i Semantic Kernel SDK för att driva dina agenter. Det innebär att om du kör någon fråga eller kod i semantisk kernel är kerneln alltid tillgänglig för att hämta nödvändiga tjänster och plugin-program.

Detta är mycket kraftfullt, eftersom det innebär att du som utvecklare har en enda plats där du kan konfigurera, och viktigast av allt övervaka, dina AI-agenter. Ta till exempel när du anropar en uppmaning från kerneln. När du gör det kommer kerneln...

- Välj den bästa AI-tjänsten för att köra uppmaningen.

- Skapa prompten med hjälp av den angivna promptmallen.

- Skicka uppmaningen till AI-tjänsten.

- Ta emot och parsa svaret.

- Och slutligen returnera svaret från LLM till ditt program.

Under hela den här processen kan du skapa händelser och mellanprogram som utlöses i vart och ett av dessa steg. Det innebär att du kan utföra åtgärder som loggning, tillhandahålla statusuppdateringar till användare och viktigast av allt ansvarsfull AI. Allt från en enda plats.

Skapa en kernel med tjänster och plugin-program

Innan du skapar en kernel bör du först förstå de två typer av komponenter som finns:

| Komponenter | beskrivning | |

|---|---|---|

| 1 | Tjänster | Dessa består av både AI-tjänster (t.ex. chattavslut) och andra tjänster (t.ex. loggning och HTTP-klienter) som krävs för att köra ditt program. Detta modellerades efter mönstret För tjänstprovidern i .NET så att vi kunde stödja beroendeinmatning på alla språk. |

| 2 | Plugin-program | Det här är de komponenter som används av dina AI-tjänster och promptmallar för att utföra arbete. AI-tjänster kan till exempel använda plugin-program för att hämta data från en databas eller anropa ett externt API för att utföra åtgärder. |

Börja skapa en kernel genom att importera nödvändiga paket överst i filen:

using Microsoft.Extensions.DependencyInjection;

using Microsoft.Extensions.Logging;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.Plugins.Core;

Sedan kan du lägga till tjänster och plugin-program. Nedan visas ett exempel på hur du kan lägga till en Azure OpenAI-chatt, en loggare och ett tids-plugin-program.

// Create a kernel with a logger and Azure OpenAI chat completion service

var builder = Kernel.CreateBuilder();

builder.AddAzureOpenAIChatCompletion(modelId, endpoint, apiKey);

builder.Services.AddLogging(c => c.AddDebug().SetMinimumLevel(LogLevel.Trace));

builder.Plugins.AddFromType<TimePlugin>();

Kernel kernel = builder.Build();

Importera nödvändiga paket:

from semantic_kernel import Kernel

from semantic_kernel.connectors.ai.open_ai import AzureChatCompletion

from semantic_kernel.core_plugins.time_plugin import TimePlugin

Sedan kan du skapa en kernel.

# Initialize the kernel

kernel = Kernel()

Slutligen kan du lägga till nödvändiga tjänster och plugin-program. Nedan visas ett exempel på hur du kan lägga till en Azure OpenAI-chatt, en loggare och ett tids-plugin-program.

# Add the Azure OpenAI chat completion service

kernel.add_service(AzureChatCompletion(model_id, endpoint, api_key))

# Add a plugin

kernel.add_plugin(

TimePlugin(),

plugin_name="TimePlugin",

)

Skapa en kernel

Kernels kan skapas med hjälp av en Kernel.builder(). På så sätt kan du lägga till nödvändiga AI-tjänster och plugin-program.

Kernel kernel = Kernel.builder()

.withAIService(ChatCompletionService.class, chatCompletionService)

.withPlugin(lightPlugin)

.build();

Använda beroendeinmatning

I C# kan du använda beroendeinmatning för att skapa en kernel. Detta görs genom att skapa en ServiceCollection och lägga till tjänster och plugin-program i den. Nedan visas ett exempel på hur du kan skapa en kernel med hjälp av beroendeinmatning.

Dricks

Vi rekommenderar att du skapar en kernel som en tillfällig tjänst så att den tas bort efter varje användning eftersom plugin-samlingen kan ändras. Kerneln är extremt lätt (eftersom det bara är en container för tjänster och plugin-program), så att skapa en ny kernel för varje användning är inte ett prestandaproblem.

using Microsoft.SemanticKernel;

var builder = Host.CreateApplicationBuilder(args);

// Add the OpenAI chat completion service as a singleton

builder.Services.AddOpenAIChatCompletion(

modelId: "gpt-4",

apiKey: "YOUR_API_KEY",

orgId: "YOUR_ORG_ID", // Optional; for OpenAI deployment

serviceId: "YOUR_SERVICE_ID" // Optional; for targeting specific services within Semantic Kernel

);

// Create singletons of your plugins

builder.Services.AddSingleton(() => new LightsPlugin());

builder.Services.AddSingleton(() => new SpeakerPlugin());

// Create the plugin collection (using the KernelPluginFactory to create plugins from objects)

builder.Services.AddSingleton<KernelPluginCollection>((serviceProvider) =>

[

KernelPluginFactory.CreateFromObject(serviceProvider.GetRequiredService<LightsPlugin>()),

KernelPluginFactory.CreateFromObject(serviceProvider.GetRequiredService<SpeakerPlugin>())

]

);

// Finally, create the Kernel service with the service provider and plugin collection

builder.Services.AddTransient((serviceProvider)=> {

KernelPluginCollection pluginCollection = serviceProvider.GetRequiredService<KernelPluginCollection>();

return new Kernel(serviceProvider, pluginCollection);

});

Nästa steg

Nu när du förstår kerneln kan du lära dig mer om alla olika AI-tjänster som du kan lägga till i den.