提交批次執行及評估流程

若要評估使用大型資料集執行流程的程度,您可以在提示流程中提交批次執行及使用內建評估方法。

在本文中,您將了解:

- 提交批次執行及使用內建評估方法

- 檢視評估結果和計量

- 開始新一輪的評估

- 檢查批次執行歷程記錄及比較計量

- 了解內建評估計量

- 改善流程效能的方法

- 深入閱讀:建立用於 Copilot 品質保證的黃金資料集的指導

您可以遵循此影片教學課程,提交批次執行及評估流程影片教學課程,快速開始測試和評估流程。

必要條件

若要執行批次執行及使用評估方法,您必須備妥下列項目:

- 批次執行的測試資料集。 您的資料集應為下列其中一種格式:

.csv、.tsv或.jsonl。 您的資料也應該包含符合流程輸入名稱的標頭。 深入閱讀:如果您要建置自己的 Copilot,建議您參閱建立用於 Copilot 品質保證的黃金資料集的指導。

提交批次執行及使用內建評估方法

批次執行可讓您使用大型資料集執行流程,並為每個資料列產生輸出。 您也可以選擇評估方法,將流程的輸出與特定準則和目標進行比較。 評估方法是一種特殊的流程類型,可根據不同層面計算流程輸出的計量。 評估執行會執行,以在提交批次執行時計算計量。

若要使用評估啟動批次執行,您可以選取流程頁面右上角的 [評估] 按鈕。

若要提交批次執行,您可以選取要用來測試流程的資料集。 您也可以選取評估方法來計算流程輸出的計量。 如果您不想使用評估方法,您可以略過此步驟並執行批次執行,而不計算任何計量。 您也可以稍後開始新一輪的評估。

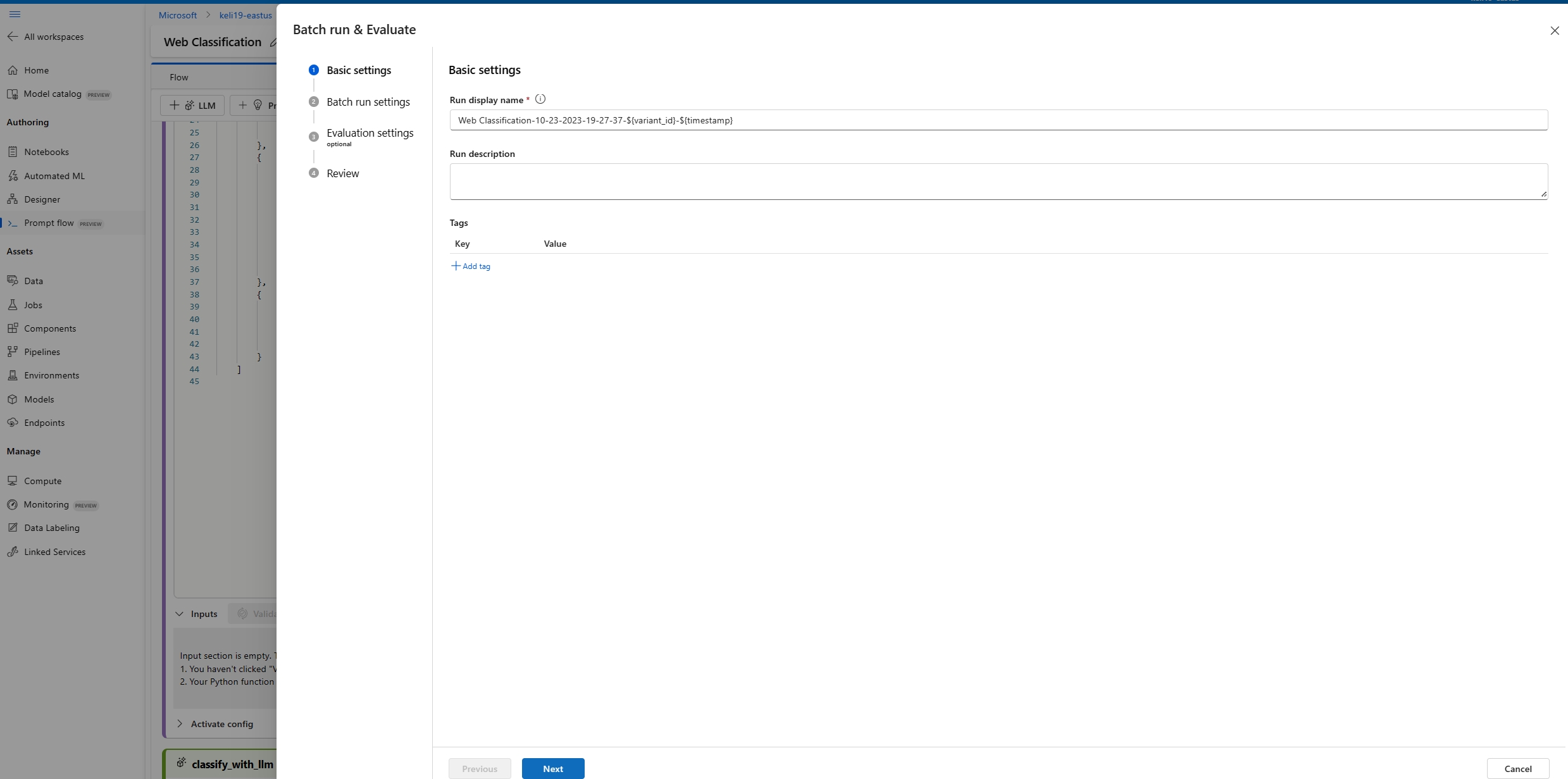

首先,系統會要求您為批次執行提供描述性且可辨識的名稱。 您也可以撰寫描述,並將標記 (機碼值組) 新增至批次執行。 完成設定之後,請選取 [下一步] 繼續。

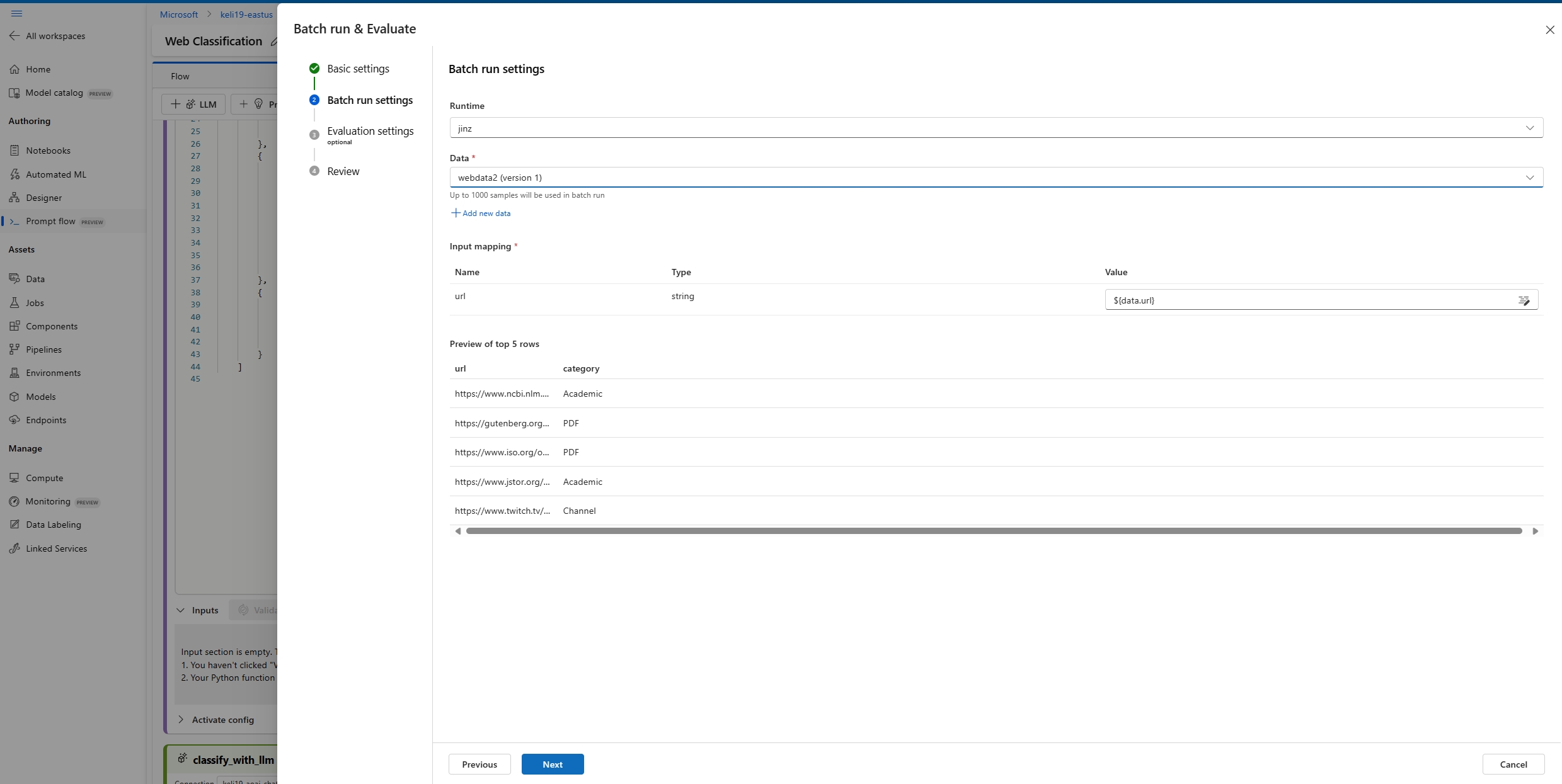

其次,您必須選取或上傳想要用來測試流程的資料集。

提示流程也支援將流程輸入對應至資料集中的特定資料行。 這表示您可以將資料行指派給特定輸入。 您可以參考具有 ${data.XXX} 格式的資料行,將資料行指派給輸入。 如果您想要將常數值指派給輸入,您可以直接輸入該值。

接著在下一個步驟中,您可以決定使用評估方法立即或稍後驗證此執行的效能。 針對已完成的批次執行,仍然可以新增新一輪的評估。

您可以直接選取 [下一步] 按鈕,略過此步驟並執行批次執行,而不使用任何評估方法來計算計量。 如此一來,此批次執行只會產生資料集的輸出。 您可以手動檢查輸出,或匯出這些輸出以使用其他方法進行進一步分析。

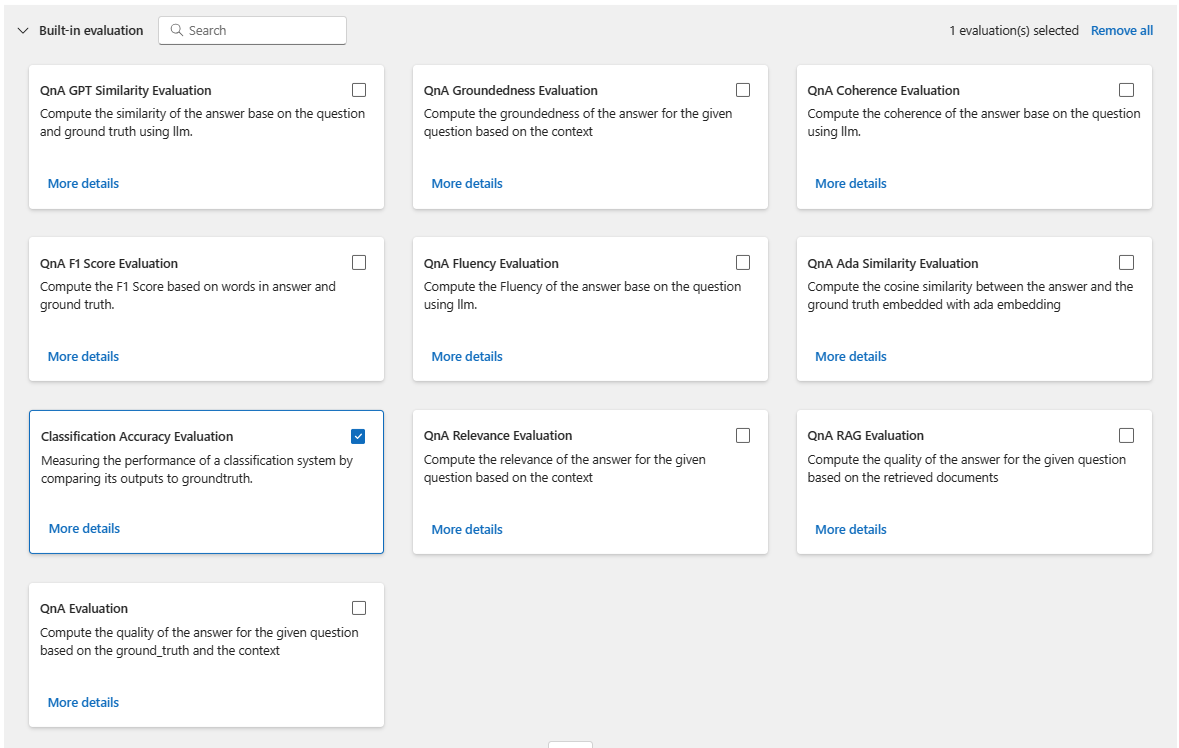

否則,如果您想要立即使用評估來執行批次執行,您可以根據所提供的描述來選取一或多個評估方法。 您可以選取 [詳細資料] 按鈕,以查看評估方法的詳細資訊,例如所產生的計量,以及所需的連線和輸入。

移至下一個步驟並設定評估設定。 在 [評估輸入對應] 區段中,您必須指定評估方法所需的輸入資料來源。 例如,有根據事實資料行可能來自資料集。 根據預設,評估會使用與提供給測試回合的測試資料集相同的資料集。 不過,如果對應的標籤或目標有根據事實值位於不同的資料集中,您可以輕鬆地切換至該資料集。

因此,若要執行評估,您必須指出這些必要輸入的來源。 若要這樣做,提交評估時,您會看到 [評估輸入對應] 區段。

- 如果資料來源是來自您的執行輸出,則來源會表示為「${run.output.[OutputName]}」

- 如果資料來源是來自您的測試資料集,則來源會表示為「${data.[ColumnName]}」

注意

如果您的評估不需要來自資料集的資料,則不需要參考輸入對應區段中的任何資料集資料行,表示資料集選取是選擇性的設定。 資料集選取項目不會影響評估結果。

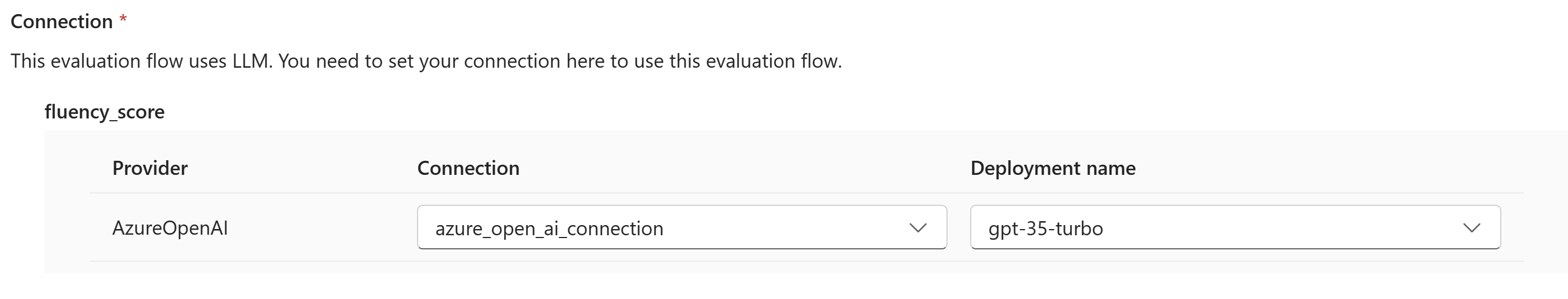

如果評估方法使用大型語言模型 (LLM) 來測量流程回應的效能,您也必須在評估方法中設定 LLM 節點的連線。

注意

某些評估方法需要 GPT-4 或 GPT-3 才能執行。 您必須先提供這些評估方法的有效連線,才能使用這些方法。 某些評估程式可能會佔用許多權杖,因此建議使用可支援 >=16k 權杖的模型。

完成輸入對應之後,請選取 [下一步] 來檢閱您的設定,然後選取 [提交] 以使用評估開始批次執行。

注意

批次執行的最大持續時間為 10 小時。 如果批次執行超過此限制,則會終止並標為失敗。 建議您監視您的大型語言模型 (LLM) 容量,以避免節流。 如有必要,請考慮減少資料大小。 如果您繼續遇到問題或需要進一步的協助,請不吝透過意見反應表格或支援要求連絡產品團隊。

檢視評估結果和計量

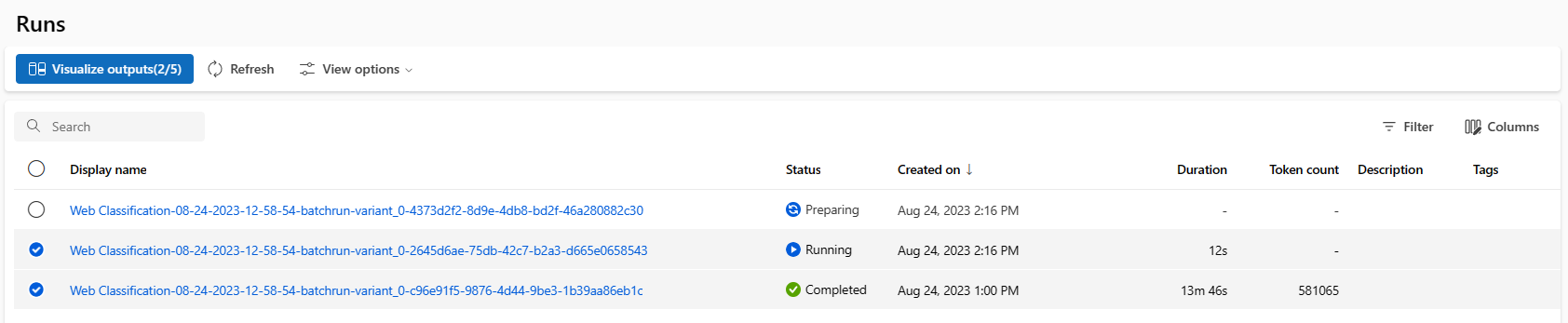

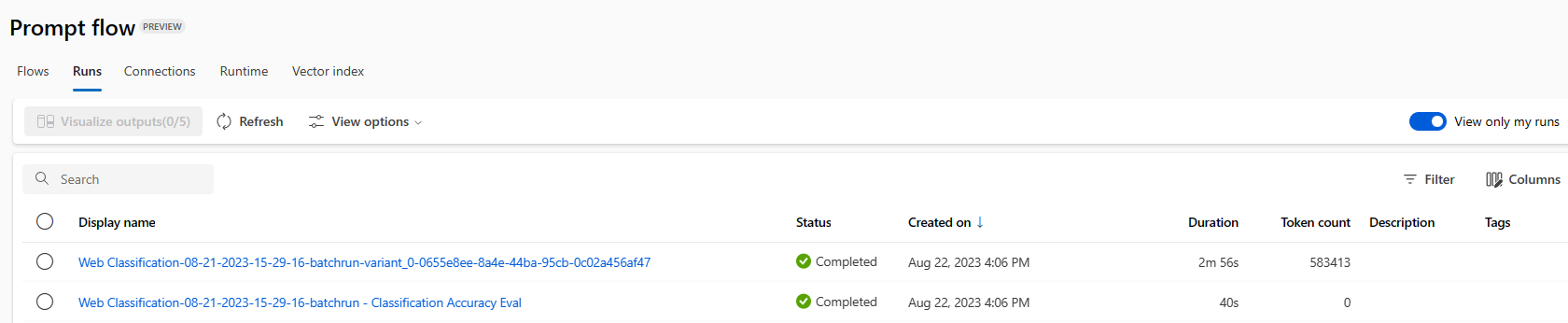

提交之後,您可以在提示流程頁面中的執行清單索引標籤中找到提交的批次執行。

選取執行以瀏覽至 [執行結果] 頁面,以檢查此批次執行的結果。

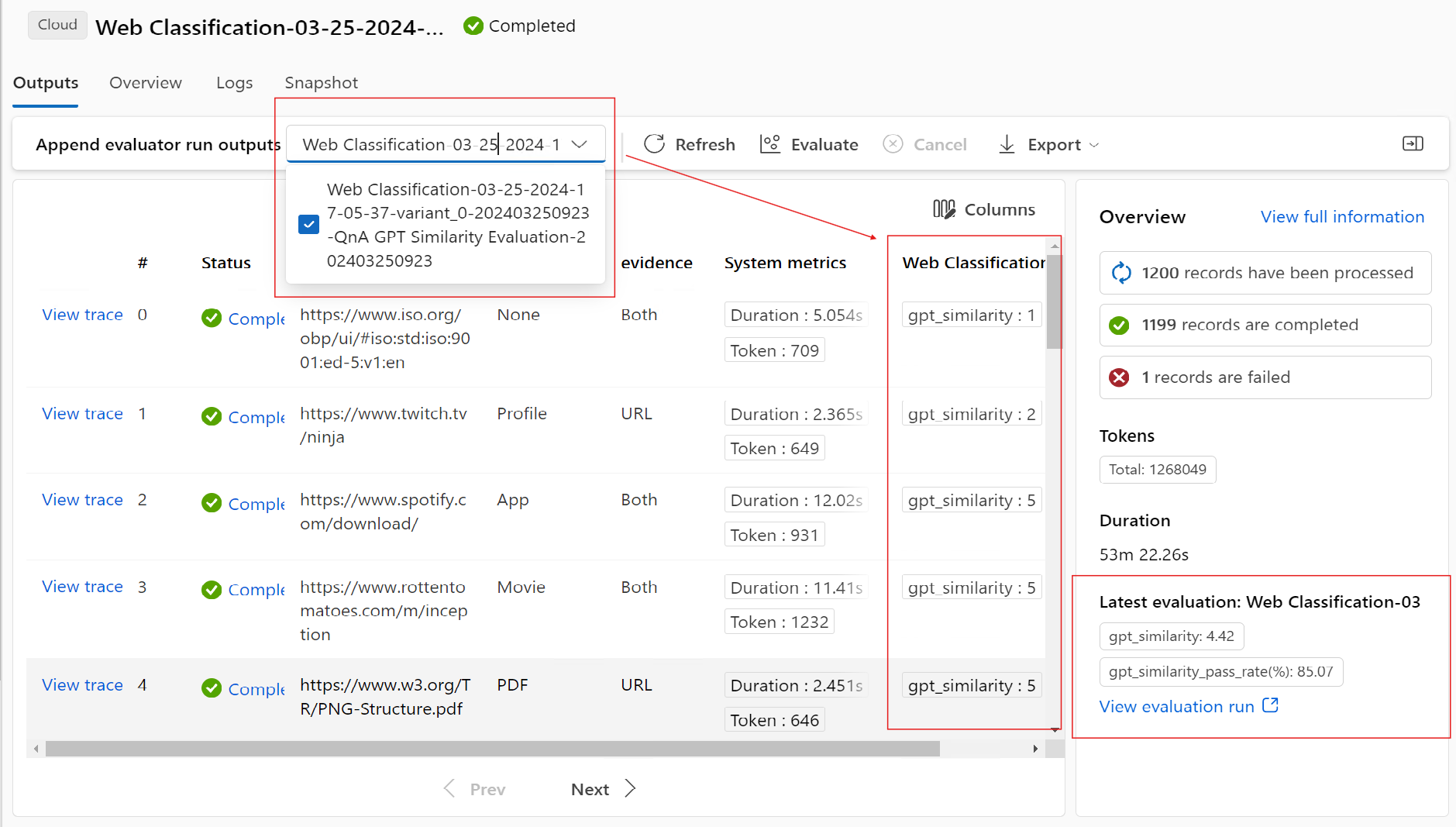

輸出

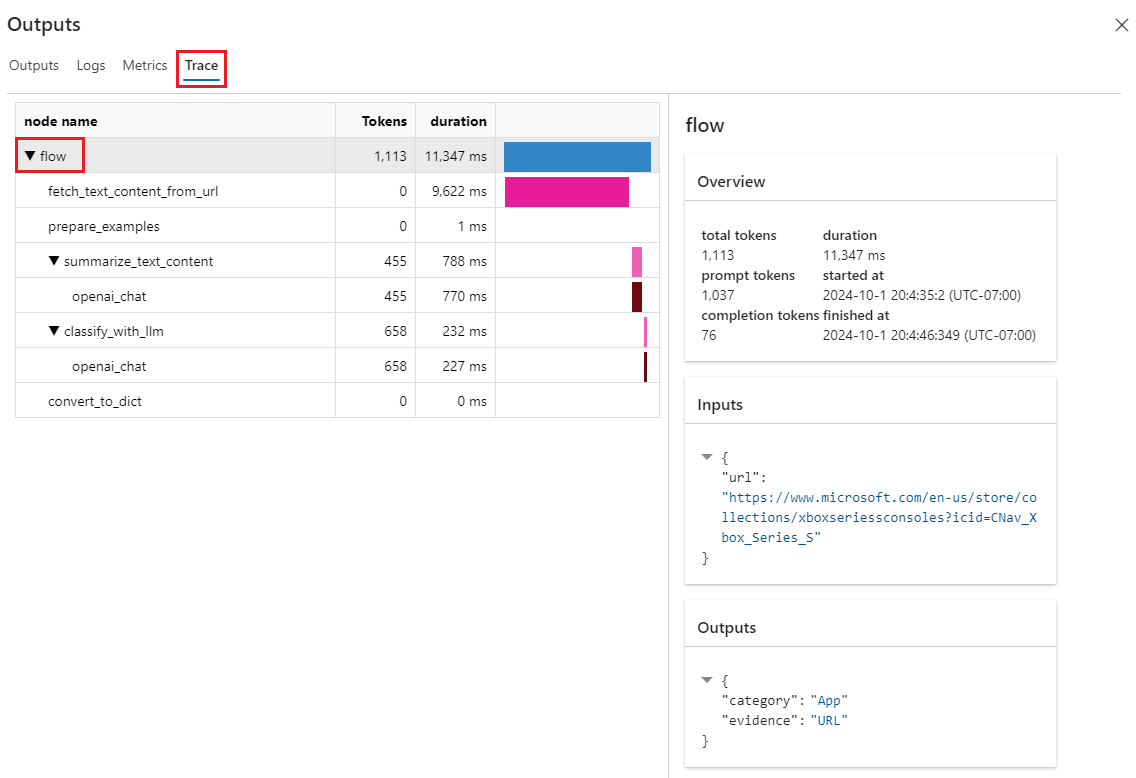

基本結果和追蹤

這會先將您導向至 [輸出] 索引標籤, 以逐行檢視輸入和輸出。 輸出索引標籤面會顯示結果的資料表清單,包括資料行識別碼、輸入、輸出、狀態、系統計量,以及建立時間。

針對每一行,選取 [檢視追蹤] 可讓您在其追蹤詳細頁面中觀察和偵錯該特定測試案例。

附加評估結果和追蹤

選取附加評估輸出能讓您選取相關評估執行,且您會在資料表結尾看到附加的資料行,其中顯示每個資料列的評估結果。 您可以附加多個評估輸出以進行比較。

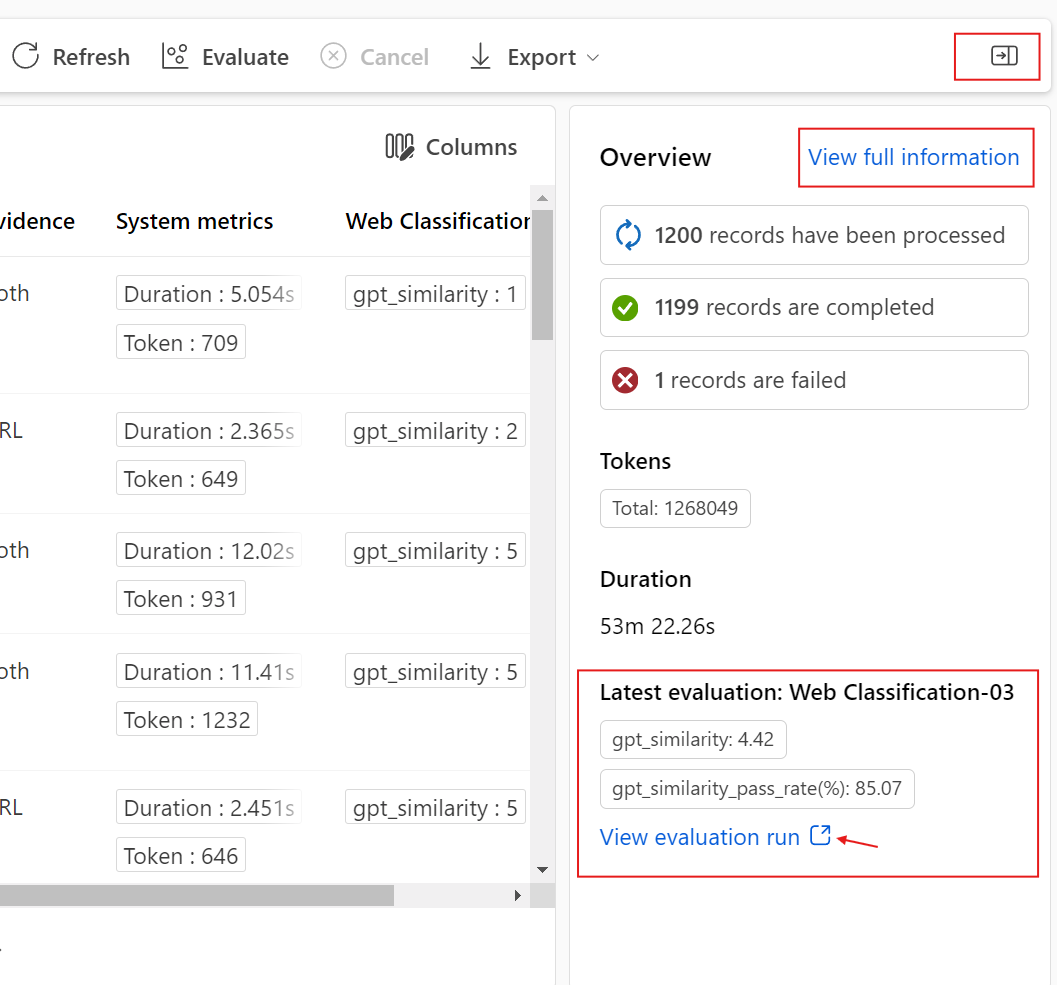

您可以在左側 [概觀] 面板中看到最新的評估計量。

基本概觀

右側 [概觀] 提供執行的整體資訊,例如每個資料點執行次數、權杖總數及執行持續時間。

依預設會顯示最新的評估回合彙總計量,您可以選取 [檢視評估回合] 來跳躍以檢視評估回合本身。

概觀可以在此展開和折疊,您可以選取 [檢視完整資訊],這會引導您前往 [輸出] 索引標籤旁的 [概觀] 索引標籤,其中包含此執行的詳細資訊。

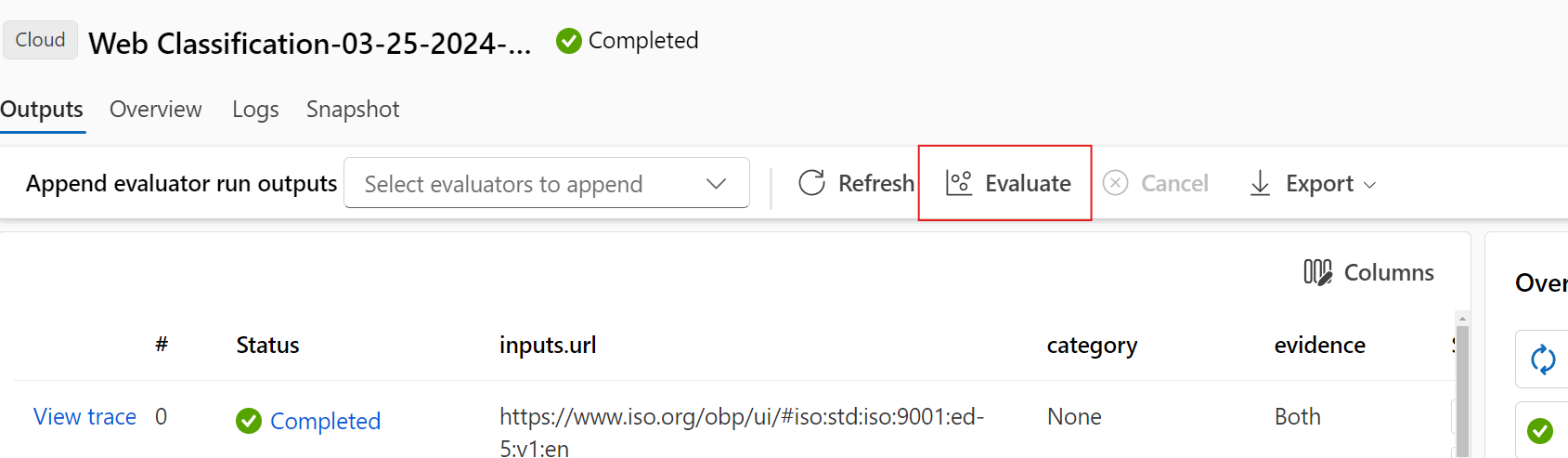

開始新一輪的評估

如果您已完成批次執行,您可以啟動另一輪的評估,提交新的評估執行以計算輸出的計量,不需再次執行您的流程。 這很有幫助,而且在下列情況下重新執行流程可以節省成本:

- 您未選取評估方法來計算提交批次執行時的計量,並決定立即執行。

- 您已經使用評估方法來計算計量。 您可以開始另一輪的評估,以計算另一個計量。

- 您的評估執行失敗,但您的流程已成功產生輸出。 您可以再次提交您的評估。

您可以選取 [評估] 開始另一輪的評估。

設定組態之後,您可以針對這個新一輪的評估選取 [提交]。 提交之後,您就能夠在提示流程執行清單中看到新的記錄。 評估執行完成後,您同樣可以在批次執行詳細資料面板的 [輸出] 索引標籤中檢查評估結果。 您需要選取新的評估執行來檢視其結果。

若要深入了解內建評估方法所計算的計量,請瀏覽至了解內建評估計量。

概觀

選取 [概觀] 索引標籤會顯示執行的完整資訊,包括執行屬性、輸入資料集、輸出資料集、標籤和描述。

記錄

選取 [記錄] 索引標籤可讓您檢視執行記錄,這對於詳細的執行錯誤偵錯很有用。 您可以將記錄檔下載到本機電腦。

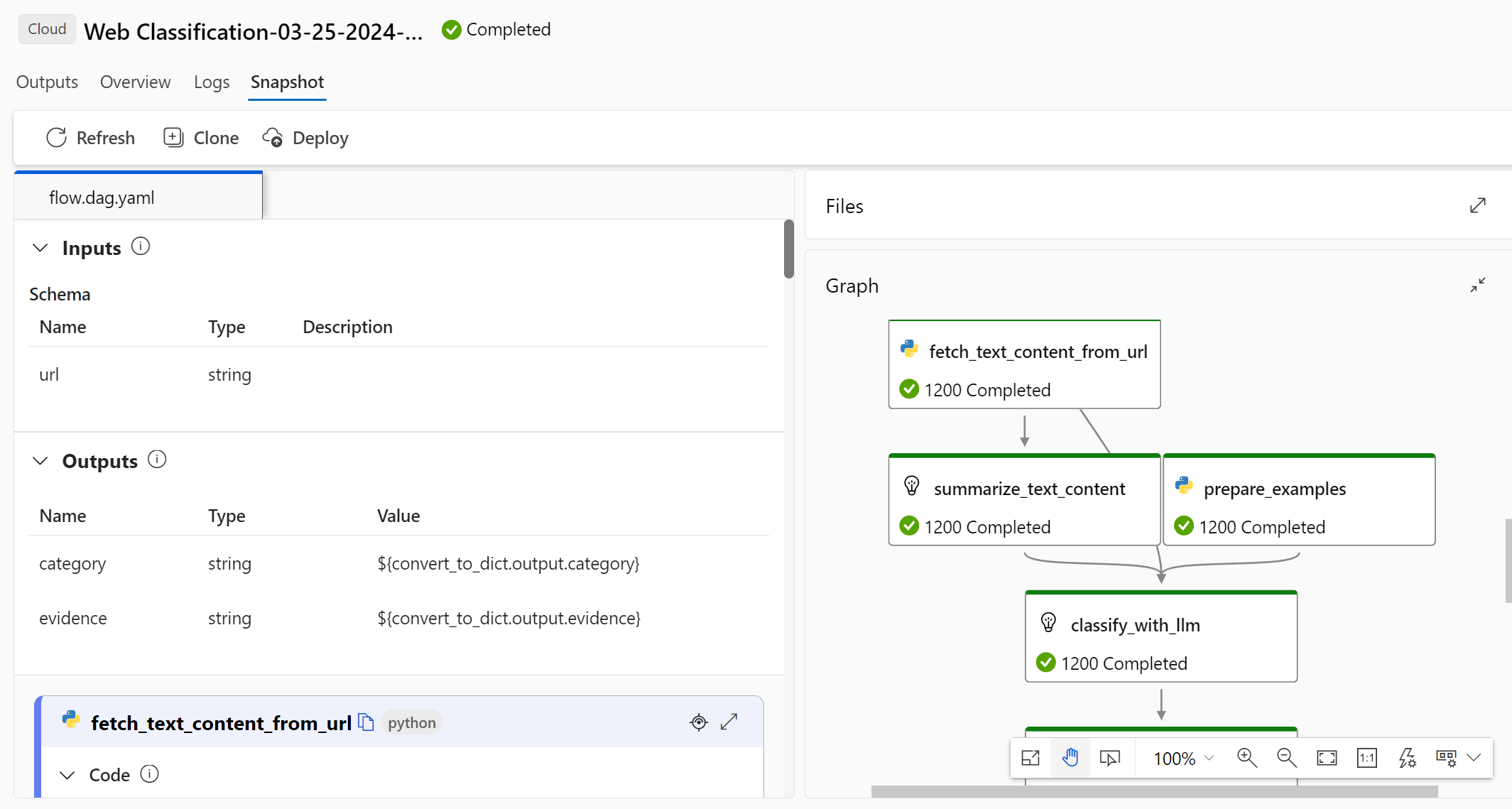

快照式

選取 [快照集] 索引標籤,會顯示執行快照集。 您可以檢視流程的 DAG。 此外,您可以選擇複製其來建立新的流程。 您也可以將其部署為在線端點。

檢查批次執行歷程記錄及比較計量

在某些情況下,您會修改流程以改善其效能。 您可以提交多個批次執行,以比較流程與不同版本的效能。 您也可以比較不同評估方法所計算的計量,以查看哪一個更適合您的流程。

若要檢查流程的批次執行歷程記錄,您可以選取流程頁面右上角的 [檢視批次執行] 按鈕。 您會看到已針對此流程提交的批次執行清單。

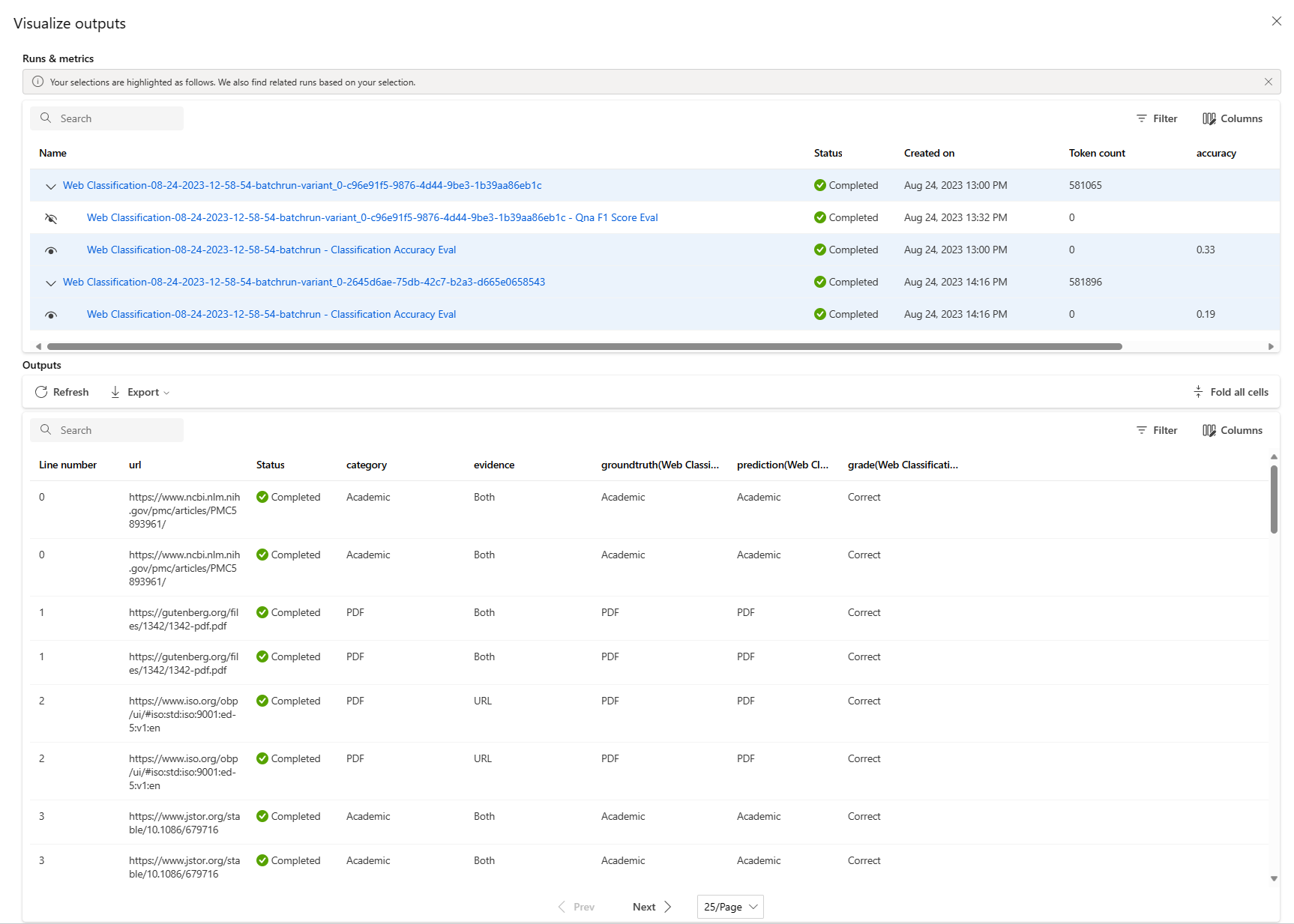

您可以選取每個批次執行以檢查詳細資料。 您也可以選取多個批次執行,然後選取「視覺化輸出」,以比較該批次執行的計量和輸出。

在 [視覺化輸出] 面板中,[執行和計量] 資料表會顯示所選取執行的資訊,並且有醒目提示。 也會列出採用所選取執行輸出作為輸入的其他執行。

在 [輸出] 資料表中,您可以依據每個範例行比較已選取批次執行。 選取 [執行和計量] 資料表中的「眼睛視覺化」圖示,該執行的輸出將會附加至對應的基底執行。

了解內建評估計量

在提示流程中,我們提供多個內建評估方法,協助您測量流程輸出的效能。 每個評估方法都會計算不同的計量。 現在我們提供九種可用的內建評估方法。 您可以檢視下表以取得快速參考:

| 評估方法 | 計量 | 描述 | 需要連線 | 必要輸入 | 分數值 |

|---|---|---|---|---|---|

| 分類正確性評估 | 準確率 | 藉由比較分類系統的輸出與有根據事實來測量分類系統的效能。 | No | 預測,有根據事實 | 範圍 [0, 1]。 |

| QnA 相關性分數成對評估 | 分數,贏/輸 | 評估問題解答系統所產生的答案品質。 牽涉到根據與使用者問題的相符程度、比較不同答案與基準答案,以及彙總結果以產生計量 (例如平均勝率和相關性分數),將相關性分數指派給每個答案。 | Yes | 問題、回答 (沒有有根據事實或內容) | 分數:0-100,贏/輸:1/0 |

| QnA 根據性評估 | 根據性 | 測量模型預測答案在輸入來源中多麼有根據。 即使 LLM 的回應為 true,如果無法針對來源進行驗證,則為無根據。 | Yes | 問題、回答,內容 (沒有有根據事實) | 1 到 5,1 是最差,5 是最佳。 |

| QnA GPT 相似度評估 | GPT 相似度 | 測量使用者提供的有根據事實答案與使用 GPT 模型的模型預測答案之間的相似度。 | Yes | 問題、回答,有根據事實 (不需要內容) | 1 到 5,1 是最差,5 是最佳。 |

| QnA 相關性評估 | 相關性 | 測量模型的預測答案與所詢問的問題有多相關。 | Yes | 問題、回答,內容 (沒有有根據事實) | 1 到 5,1 是最差,5 是最佳。 |

| QnA 連貫性評估 | 連貫性 | 測量模型預測答案中所有句子的品質,以及其自然地結合在一起的程度。 | Yes | 問題、回答 (沒有有根據事實或內容) | 1 到 5,1 是最差,5 是最佳。 |

| QnA 流暢度評估 | 流暢度 | 測量模型預測答案的文法和語言正確程度。 | Yes | 問題、回答 (沒有有根據事實或內容) | 1 到 5,1 是最差,5 是最佳 |

| QnA f1 分數評估 | F1 分數 | 測量模型預測與有根據事實之間共用字數的比例。 | No | 問題、回答,有根據事實 (不需要內容) | 範圍 [0, 1]。 |

| QnA Ada 相似度評估 | Ada 相似度 | 使用 Ada 內嵌 API 針對有根據事實和預測來計算句子 (文件) 層級內嵌。 然後計算它們之間的餘弦相似度 (一個浮點數) | Yes | 問題、回答,有根據事實 (不需要內容) | 範圍 [0, 1]。 |

改善流程效能的方法

從評估中檢查內建計量之後,您可以嘗試透過下列方式改善流程效能:

- 檢查輸出資料,以偵錯流程的任何潛在失敗。

- 修改您的流程以改善其效能。 其中包括但不限於:

- 修改提示

- 修改系統訊息

- 修改流程的參數

- 修改流程邏輯

提示建構可能很困難。 我們提供提示工程的簡介,協助您了解建構可達成目標的提示概念。 若要深入了解如何建構可達成目標的提示,請參閱提示工程技術。

系統訊息,有時稱為中繼提示或系統提示,可用來引導 AI 系統的行為並改善系統效能。 請閱讀本文件的大型語言模型 (LLM) 的系統訊息架構和範本建議,以了解如何使用系統訊息改善您的流程效能。

深入閱讀:建立用於 Copilot 品質保證的黃金資料集的指導

建立使用大型語言模型 (LLM) 的 Copilot 通常牽涉到使用來源資料集為模型提供現實世界的根據。 不過,為了確保 LLM 對客戶查詢提供最正確且實用的回應,「黃金資料集」是必要的。

「黃金資料集」是實際客戶問題和精心製作解答的集合。 可作為您的 Copilot 所使用 LLM 的品質保證工具。 黃金資料集不會用來定型 LLM 或將內容插入 LLM 提示中。 而是用來評估 LLM 所產生答案的品質。

如果您的案例牽涉到 Copilot,或您正在建置自己的 Copilot,建議您參考此特定文件:產生黃金資料集:建立用於 Copilot 品質保證的黃金資料集指導,以取得更詳細的指導和最佳做法。

下一步

在本文件中,您已了解如何提交批次執行,並使用內建評估方法來測量流程輸出的品質。 您也了解如何檢視評估結果和計量,以及如何使用不同的方法或變體子集來開始新一輪的評估。 我們希望本文件可協助您改善流程效能,並使用提示流程達成目標。

![您在檢查批次執行輸出的 [輸出] 索引標籤上批次執行結果頁面的螢幕擷取畫面。](media/how-to-bulk-test-evaluate-flow/batch-run-output.png?view=azureml-api-2)

![Web 分類的螢幕擷取畫面,其中已選取 [檢視大量執行] 按鈕。](media/how-to-bulk-test-evaluate-flow/batch-run-history.png?view=azureml-api-2)