Microsoft Fabric Apache Spark 工作區管理設定

適用於:Microsoft Fabric 中的 ✅ 資料工程和資料科學

在 Microsoft Fabric 中建立工作區時,會自動建立與該工作區相關聯的入門集區。 透過 Microsoft Fabric 中的簡易設定,不需要選擇節點或機器大小,因為這些選項會在幕後為您處理。 此設定提供更快速 (5-10 秒) 的 Apache Spark 工作階段啟動體驗,讓使用者在許多常見案例中開始使用和執行 Apache Spark 工作,而不必擔心設定計算。 針對具有特定計算需求的進階案例,使用者可以建立自訂 Apache Spark 集區,並根據節點的效能需求來調整節點大小。

若要變更工作區中的 Apache Spark 設定,需擁有該工作區的管理員角色。 若要深入了解,請參閱<工作區中的角色>。

若要管理與工作區相關聯的集區 Spark 設定:

前往工作區中的 [工作區設定],然後選擇 [資料工程/科學] 選項以展開功能表:

您會在左邊功能表中看到 [Spark 計算] 選項:

注意

如果將預設集區從 [入門集區] 變更為 [自訂 Spark 集區],則可能需要較長的工作階段啟動時間 (~3 分鐘)。

集區

工作區的預設集區

您可以為工作區使用自動建立的入門集區,或建立自訂集區。

入門集區:預先凍結的即時集區會自動建立,帶來更快速的體驗。 這些叢集為中型大小。 入門集區會根據購買的 Fabric 容量 SKU 設定為預設組態。 管理員可以根據其 Spark 工作負載規模需求來自訂最大節點和執行程式。 若要深入了解,請參閱<設定入門集區>。

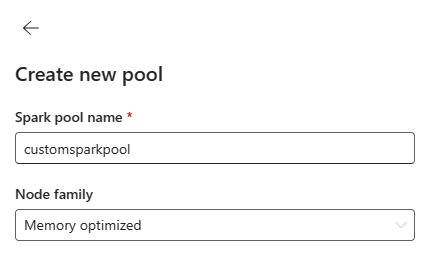

自訂 Spark 集區:您可以根據您的 Spark 工作需求調整節點大小、自動縮放,以及動態配置執行程式。 若要建立自訂 Spark 集區,容量管理員應該在 [容量管理員]設定的 [Spark 計算] 區段中啟用 [自訂工作區集區] 選項。

注意

預設啟用自訂工作區集區的容量層級控制。 若要深入了解,請參閱<設定和管理 Fabric 容量的資料工程和資料科學設定。

管理員可以選取 [新增集區] 選項,根據計算需求建立自訂 Spark 集區。

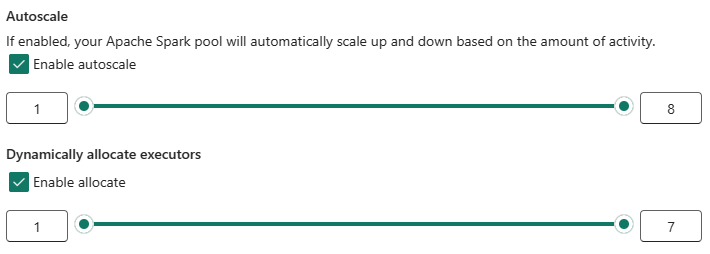

Microsoft Fabric Apache Spark 支援單一節點叢集,可讓使用者選取最小節點組態為 1,在此情況下,驅動程式和執行程式會在單一節點中執行。 這些單一節點叢集可在節點失敗的情況下提供可還原的高可用性,並且為具有較小計算需求的工作負載提供更好的工作可靠性。 您也可以為自訂 Spark 集區啟用或停用自動縮放選項。 啟用自動縮放時,集區會在使用者指定的最大節點限制內取得新的節點,並在工作執行之後淘汰這些節點,以提升效能。

您也可以選取選項,以動態方式配置執行程式,以根據資料磁碟區在指定的最大界限內自動將最佳數目的執行程式設為集區,以獲得更佳的效能。

深入了解適用於 Fabric 的 Apache Spark 計算。

- 自訂項目的計算組態:針對使用環境的筆記本、Spark 工作定義等個別項目,工作區管理員可以允許使用者調整計算組態 (包括 驅動程式/執行程式核心、驅動程式/執行程式記憶的工作階段層級屬性)。

如果工作區管理員關閉設定,預設集區及其計算組態將會用於工作區中的所有環境。

環境

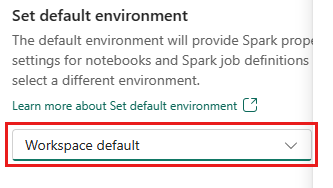

環境提供彈性的設定來執行 Spark 工作 (筆記本、Spark 工作定義)。 在環境中,可根據工作負載需求設定計算屬性、選取不同的執行階段、設定程式庫封裝相依性。

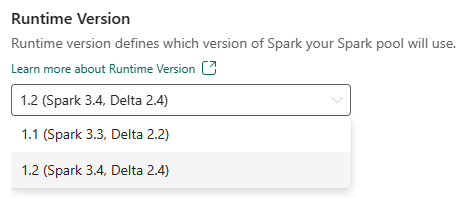

在 [環境] 索引標籤中,有設定預設環境的選項。 您可以選擇要用於工作區的 Spark 版本。

Fabric 工作區管理員可以選取一個 [環境] 作為工作區預設環境。

您也可以透過 [環境] 下拉式清單建立新的環境。

如果您停用預設環境的選項,可以選擇從下拉式清單中所列的可用執行階段版本選取 Fabric 執行階段版本。

深入了解 Apache Spark 執行階段。

高並行

高並行模式可讓使用者在 Fabric 資料工程和資料科學工作負載的 Apache Spark 中共用相同的 Spark 工作階段。 如筆記本等項目會使用 Spark 工作階段來執行,且在啟用時,使用者可跨多個筆記本共享單一 Spark 工作階段。

深入了解 適用於 Fabric 的 Apache Spark 中的高並行。

適用於機器學習模型和實驗的自動記錄

管理員現在可以為其機器學習模型和實驗啟用自動記錄功能。 此選項會在訓練時自動擷取機器學習模型的輸入參數、輸出計量和輸出項目的值。 深入了解自動記錄。

相關內容

- 閱讀 Fabric 中的 Apache Spark 執行階段 - 概觀、版本設定、多重執行階段支援和升級、Delta Lake、通訊協定。

- 若要深入了解,請參閱 Apache Spark 公開文件。

- 尋找常見問題的解答:Apache Spark 工作區系統管理設定常見問題。

![螢幕擷取畫面,其中顯示了 [工作區設定] 功能表中 [資料工程] 的位置。](media/workspace-admin-settings/data-engineering-menu-inline.png)