クイックスタート: AI チャットで画像を使用する

Azure OpenAI Service で画像を含む GPT-4 Turbo の使用を開始します。

Note

モデルの選択

最新のビジョン対応モデルは、gpt-4o と gpt-4o mini です。 これらはパブリック プレビュー段階です。 利用可能な最新の GA モデルは、gpt-4 バージョンの turbo-2024-04-09 です。

Azure OpenAI Studio を使用すると、コードを書かなくても GPT-4 Turbo with Vision 機能の確認を開始できます。

前提条件

- Azure サブスクリプション。 無料で作成できます。

- GPT-4 Turbo with Vision モデルがデプロイされた Azure OpenAI Service リソース。 使用可能なリージョンについては、 GPT-4 および GPT-4 Turbo プレビュー モデルの可用性 に関するページを参照してください。 リソース作成の詳細については、リソース デプロイ ガイドを参照してください。

Note

現在、GPT-4 Turbo with Vision モデルのコンテンツ フィルター処理をオフにすることはサポートされていません。

Azure OpenAI Studio に移動する

Azure OpenAI Studio にアクセスし、Azure OpenAI リソースに関連付けられた資格情報を使用してサインインします。 サインイン ワークフローの途中または後で、適切なディレクトリ、Azure サブスクリプション、Azure OpenAI リソースを選択します。

[管理] で [デプロイ] を選択し、GPT-4 Turbo with Vision デプロイを作成します。その際、モデル名に "gpt-4" を、モデル バージョンに "vision-preview" を選択します。 モデル デプロイの詳細については、リソース デプロイ ガイドを参照してください。

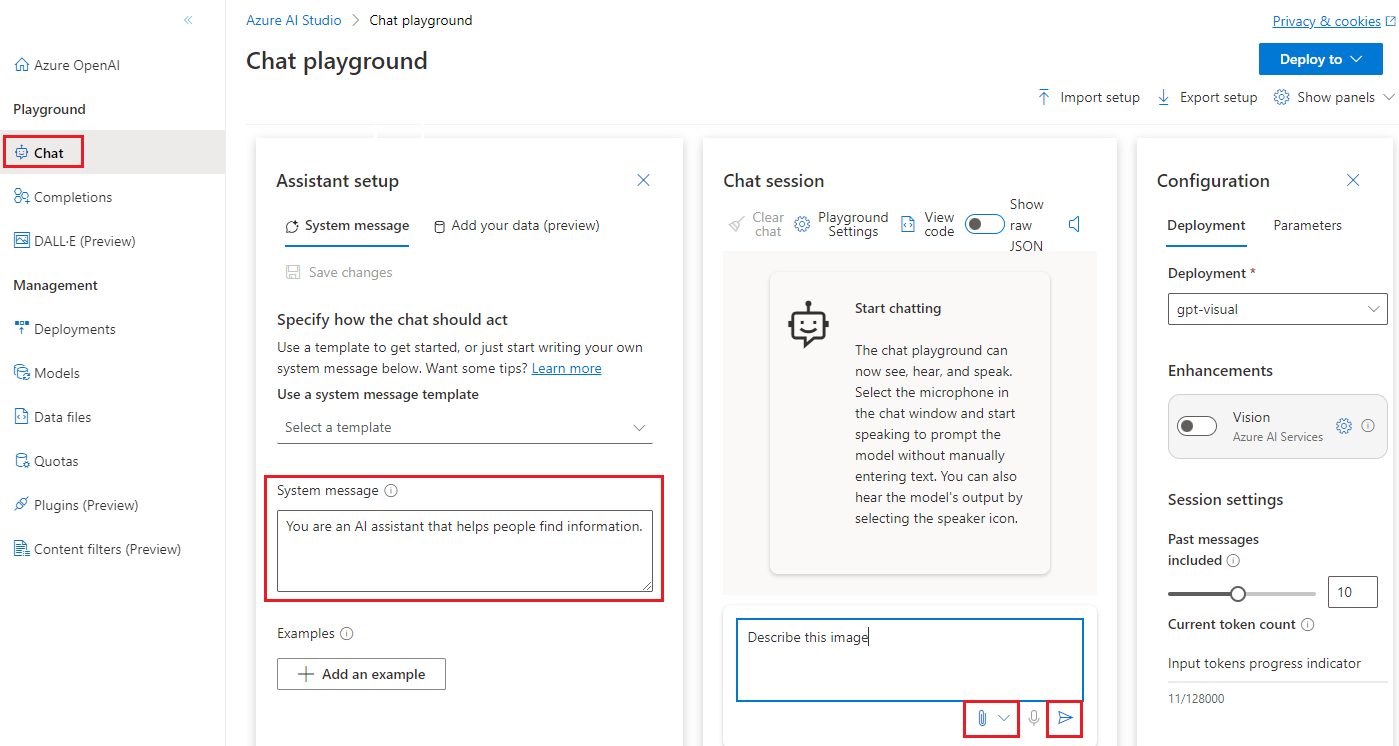

[プレイグラウンド] セクションで [チャット] を選択します。

プレイグラウンド

このページから、簡単に反復し、モデルの機能を実験することができます。

アシスタント セットアップ、チャット セッション、設定、パネルの全般的ヘルプについては、「チャットのクイックスタート」を参照してください。

チャット セッションを開始して画像やビデオを分析する

このチャット セッションでは、入力した画像を解釈できるようにアシスタントに指示します。

まず、GPT-4 Turbo with Vision デプロイをドロップダウンから選択します。

[アシスタントのセットアップ] ペインで、アシスタントをガイドするシステム メッセージを入力します。 既定のシステム メッセージは、"あなたは、情報の検索を支援する AI アシスタントです" です。アップロードする画像またはシナリオに合わせてシステム メッセージを調整できます。

Note

モデルから役に立たない応答が返されないように、タスクに特化したシステム メッセージに更新することをお勧めします。

変更を保存し、システム メッセージの更新を確定するか問われたら、[続行] を選択します。

[チャット セッション] ウィンドウで、"この画像を説明して" などのテキスト プロンプトを入力し、添付ボタンで画像をアップロードします。 ユース ケースには別のテキスト プロンプトを使用できます。 次に、[送信] を選択します。

出力を確認します。 理解を深めるため、画像の分析に関連するフォローアップの質問をすることを検討してください。

リソースをクリーンアップする

Azure OpenAI リソースをクリーンアップして削除したい場合は、リソースまたはリソース グループを削除できます。 リソース グループを削除すると、それに関連付けられている他のリソースも削除されます。

この記事を使用して、GPT-4 Turbo with Vision モデルをデプロイして使用するために Azure OpenAI REST API の使用を開始します。

前提条件

- Azure サブスクリプション。 無料で作成できます。

- Python 3.8 以降のバージョン。

- 次の Python ライブラリ:

requests、json。 - GPT-4 Turbo with Vision モデルがデプロイされた Azure OpenAI Service リソース。 使用可能なリージョンについては、 GPT-4 および GPT-4 Turbo プレビュー モデルの可用性 に関するページを参照してください。 リソース作成の詳細については、リソース デプロイ ガイドを参照してください。

Note

現在、GPT-4 Turbo with Vision モデルのコンテンツ フィルター処理をオフにすることはサポートされていません。

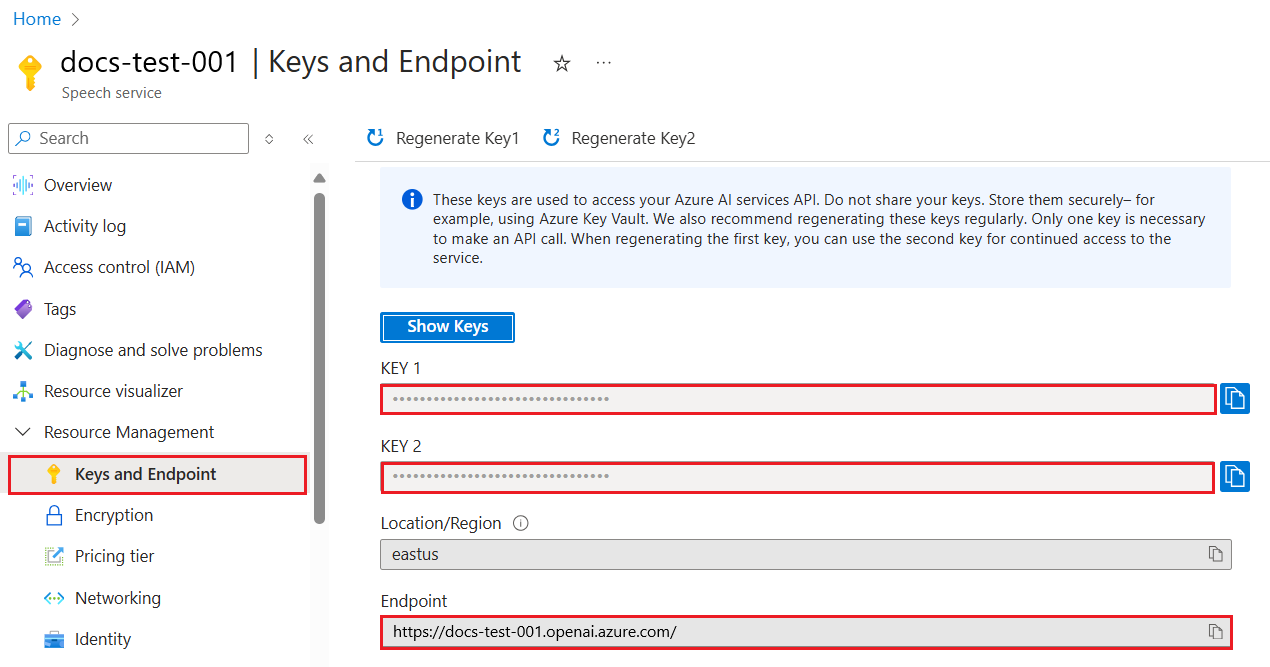

キーとエンドポイントを取得する

Azure OpenAI API を正常に呼び出すには、Azure OpenAI リソースに関する次の情報が必要です。

| 変数 | 名前 | 値 |

|---|---|---|

| エンドポイント | api_base |

エンドポイント値は、Azure portal のリソースの [キーとエンドポイント] にあります。 また、Azure AI Studio の [デプロイ] ページからエンドポイントを見つけることもできます。 エンドポイントの例: https://docs-test-001.openai.azure.com/。 |

| キー | api_key |

キー値は、Azure portal のリソースの [キーとエンドポイント] にあります。 Azure では、リソースに対して 2 つのキーが生成されます。 いずれかの値を使用できます。 |

Azure portal でリソースに移動します。 ナビゲーション ウィンドウで、[リソース管理] の [キーとエンドポイント] を選択します。 [エンドポイント] の値とアクセス キーの値をコピーします。 KEY 1 または KEY 2 のいずれかの値を使用できます。 2 つのキーを用意しておくと、サービスを中断させることなく、キーのローテーションと再生成を安全に行うことができます。

新しい Python アプリケーションを作成する

quickstart.py という名前の新しい Python ファイルを作成します。 好みのエディターまたは IDE で新しいファイルを開きます。

quickstart.py の内容を次のコードで置き換えます。

# Packages required: import requests import json api_base = '<your_azure_openai_endpoint>' deployment_name = '<your_deployment_name>' API_KEY = '<your_azure_openai_key>' base_url = f"{api_base}openai/deployments/{deployment_name}" headers = { "Content-Type": "application/json", "api-key": API_KEY } # Prepare endpoint, headers, and request body endpoint = f"{base_url}/chat/completions?api-version=2023-12-01-preview" data = { "messages": [ { "role": "system", "content": "You are a helpful assistant." }, { "role": "user", "content": [ { "type": "text", "text": "Describe this picture:" }, { "type": "image_url", "image_url": { "url": "<image URL>" } } ] } ], "max_tokens": 2000 } # Make the API call response = requests.post(endpoint, headers=headers, data=json.dumps(data)) print(f"Status Code: {response.status_code}") print(response.text)次の変更を行います。

- エンドポイント URL とキーを適切なフィールドに入力します。

- 適切なフィールドに GPT-4 Turbo with Vision デプロイ名を入力します。

"image"フィールドの値を画像の URL に変更します。ヒント

URL ではなく、Base 64 でエンコードされた画像データを使うこともできます。 詳細については、GPT-4 Turbo with Vision の攻略ガイドに関するページを参照してください。

pythonコマンドを使用してアプリケーションを実行します。python quickstart.py

リソースをクリーンアップする

Azure OpenAI リソースをクリーンアップして削除したい場合は、リソースまたはリソース グループを削除できます。 リソース グループを削除すると、それに関連付けられている他のリソースも削除されます。

この記事を参照して、Azure OpenAI Python SDK の使用を開始し、GPT-4 Turbo with Vision モデルをデプロイして使います。

ライブラリのソース コード | パッケージ (PyPi) |

前提条件

- Azure サブスクリプション。 無料で作成できます。

- Python 3.8 以降のバージョン。

- 次の Python ライブラリ:

os - GPT-4 Turbo with Vision モデルがデプロイされた Azure OpenAI Service リソース。 使用可能なリージョンについては、 GPT-4 および GPT-4 Turbo プレビュー モデルの可用性 に関するページを参照してください。 リソース作成の詳細については、リソース デプロイ ガイドを参照してください。

設定

次を使用して、OpenAI Python クライアント ライブラリをインストールします。

pip install openai

Note

このライブラリは、OpenAI によって保持されます。 このライブラリの最新の更新を追跡するには、リリース履歴を参照してください。

キーとエンドポイントを取得する

Azure OpenAI に対して正常に呼び出しを行うには、エンドポイントとキーが必要です。

| 変数名 | Value |

|---|---|

ENDPOINT |

サービス エンドポイントは、Azure portal でリソースを調べるときに、[キーとエンドポイント] セクションで確認できます。 または、Azure AI Studio の [デプロイ] ページからエンドポイントを見つけることができます。 エンドポイントの例: https://docs-test-001.openai.azure.com/。 |

API-KEY |

この値は、Azure portal からリソースを確認する際に、 [Keys & Endpoint](キーとエンドポイント) セクションで確認することができます。 KEY1 または KEY2 を使用できます。 |

Azure portal でリソースに移動します。 [キーとエンドポイント] セクションは、[リソース管理] セクションにあります。 エンドポイントとアクセス キーをコピーします。これらは、API 呼び出しを認証するために両方とも必要です。 KEY1 または KEY2 を使用できます。 常に 2 つのキーを用意しておくと、サービスを中断させることなく、キーのローテーションと再生成を安全に行うことができます。

環境変数

キーとエンドポイントの永続的な環境変数を作成して割り当てます。

重要

API キーを使用する場合は、それを Azure Key Vault などの別の場所に安全に保存します。 API キーは、コード内に直接含めないようにし、絶対に公開しないでください。

AI サービスのセキュリティの詳細については、「Azure AI サービスに対する要求の認証」を参照してください。

setx AZURE_OPENAI_API_KEY "REPLACE_WITH_YOUR_KEY_VALUE_HERE"

setx AZURE_OPENAI_ENDPOINT "REPLACE_WITH_YOUR_ENDPOINT_HERE"

新しい Python アプリケーションを作成する

quickstart.py という名前の新しい Python ファイルを作成します。 好みのエディターまたは IDE で新しいファイルを開きます。

quickstart.py の内容を次のコードで置き換えます。

from openai import AzureOpenAI api_base = os.getenv("AZURE_OPENAI_ENDPOINT") api_key= os.getenv("AZURE_OPENAI_API_KEY") deployment_name = '<your_deployment_name>' api_version = '2023-12-01-preview' # this might change in the future client = AzureOpenAI( api_key=api_key, api_version=api_version, base_url=f"{api_base}/openai/deployments/{deployment_name}" ) response = client.chat.completions.create( model=deployment_name, messages=[ { "role": "system", "content": "You are a helpful assistant." }, { "role": "user", "content": [ { "type": "text", "text": "Describe this picture:" }, { "type": "image_url", "image_url": { "url": "<image URL>" } } ] } ], max_tokens=2000 ) print(response)次の変更を行います。

- 適切なフィールドに GPT-4 Turbo with Vision デプロイの名前を入力します。

"url"フィールドの値を画像の URL に変更します。ヒント

URL ではなく、Base 64 でエンコードされた画像データを使うこともできます。 詳細については、GPT-4 Turbo with Vision の攻略ガイドに関するページを参照してください。

pythonコマンドを使用してアプリケーションを実行します。python quickstart.py

リソースをクリーンアップする

Azure OpenAI リソースをクリーンアップして削除したい場合は、リソースまたはリソース グループを削除できます。 リソース グループを削除すると、それに関連付けられている他のリソースも削除されます。

この記事を参照して OpenAI JavaScript SDK の使用を開始し、GPT-4 Turbo with Vision モデルをデプロイして使用します。

この SDK は OpenAI によって提供されており、Azure によって提供される Azure 固有の種類が含まれています。

リファレンスのドキュメント | ライブラリのソース コード | パッケージ (npm) | サンプル

前提条件

- Azure サブスクリプション - 無料アカウントを作成します

- Node.js の LTS バージョン

- Azure CLI をローカル開発環境でのパスワードレス認証に使用する場合は、Azure CLI でサインインして必要なコンテキストを作成します。

- サポートされるリージョンに作成された Azure OpenAI リソース (利用可能なリージョンの情報をご覧ください)。 詳細については、「Azure OpenAI を使用してリソースを作成し、モデルをデプロイする」を参照してください。

Note

このライブラリは、OpenAI によって保持されます。 このライブラリの最新の更新を追跡するには、リリース履歴を参照してください。

キーとエンドポイントを取得する

Azure OpenAI に対して正常に呼び出しを行うには、エンドポイントとキーが必要です。

| 変数名 | Value |

|---|---|

ENDPOINT |

サービス エンドポイントは、Azure portal でリソースを調べるときに、[キーとエンドポイント] セクションで確認できます。 または、Azure AI Studio の [デプロイ] ページからエンドポイントを見つけることができます。 エンドポイントの例: https://docs-test-001.openai.azure.com/。 |

API-KEY |

この値は、Azure portal からリソースを確認する際に、 [Keys & Endpoint](キーとエンドポイント) セクションで確認することができます。 KEY1 または KEY2 を使用できます。 |

Azure portal でリソースに移動します。 [キーとエンドポイント] セクションは、[リソース管理] セクションにあります。 エンドポイントとアクセス キーをコピーします。これらは、API 呼び出しを認証するために両方とも必要です。 KEY1 または KEY2 を使用できます。 常に 2 つのキーを用意しておくと、サービスを中断させることなく、キーのローテーションと再生成を安全に行うことができます。

環境変数

キーとエンドポイントの永続的な環境変数を作成して割り当てます。

重要

API キーを使用する場合は、それを Azure Key Vault などの別の場所に安全に保存します。 API キーは、コード内に直接含めないようにし、絶対に公開しないでください。

AI サービスのセキュリティの詳細については、「Azure AI サービスに対する要求の認証」を参照してください。

setx AZURE_OPENAI_API_KEY "REPLACE_WITH_YOUR_KEY_VALUE_HERE"

setx AZURE_OPENAI_ENDPOINT "REPLACE_WITH_YOUR_ENDPOINT_HERE"

Node アプリケーションを作成する

コンソール ウィンドウ (cmd、PowerShell、Bash など) で、ご利用のアプリ用に新しいディレクトリを作成し、そこに移動します。 次に、npm init コマンドを実行し、package.json ファイルを使用してノード アプリケーションを作成します。

npm init

クライアント ライブラリをインストールする

次のコマンドを使用してクライアント ライブラリをインストールします。

npm install openai @azure/identity

アプリの package.json ファイルは依存関係を含めて更新されます。

画像プロンプト用の新しい JavaScript アプリケーションを作成する

azure-samples/cognitive-services-sample-data-files から画像を選択し、環境変数で画像の URL を設定します。

quickstart.js の内容を次のコードに置き換えます。

const AzureOpenAI = require('openai').AzureOpenAI; const { DefaultAzureCredential, getBearerTokenProvider } = require('@azure/identity'); // You will need to set these environment variables or edit the following values const endpoint = process.env["AZURE_OPENAI_ENDPOINT"] || "<endpoint>"; const imageUrl = process.env["IMAGE_URL"] || "<image url>"; // Required Azure OpenAI deployment name and API version const apiVersion = "2024-07-01-preview"; const deploymentName = "gpt-4-with-turbo"; // keyless authentication const credential = new DefaultAzureCredential(); const scope = "https://cognitiveservices.azure.com/.default"; const azureADTokenProvider = getBearerTokenProvider(credential, scope); function getClient(): AzureOpenAI { return new AzureOpenAI({ endpoint, azureADTokenProvider, apiVersion, deployment: deploymentName, }); } function createMessages() { return { messages: [ { role: "system", content: "You are a helpful assistant." }, { role: "user", content: [ { type: "text", text: "Describe this picture:", }, { type: "image_url", image_url: { url: imageUrl, }, }, ], }, ], model: "", max_tokens: 2000, }; } async function printChoices(completion) { for (const choice of completion.choices) { console.log(choice.message); } } export async function main() { console.log("== Get GPT-4 Turbo with vision Sample =="); const client = getClient(); const messages = createMessages(); const completion = await client.chat.completions.create(messages); await printChoices(completion); } main().catch((err) => { console.error("Error occurred:", err); });次の変更を行います。

- 適切なフィールドに GPT-4 Turbo with Vision デプロイの名前を入力します。

"url"フィールドの値を画像の URL に変更します。ヒント

URL ではなく、Base 64 でエンコードされた画像データを使うこともできます。 詳細については、GPT-4 Turbo with Vision の攻略ガイドに関するページを参照してください。

次のコマンドでアプリケーションを実行します。

node quickstart.js

リソースをクリーンアップする

Azure OpenAI リソースをクリーンアップして削除したい場合は、リソースまたはリソース グループを削除できます。 リソース グループを削除すると、それに関連付けられている他のリソースも削除されます。

この記事を参照して OpenAI JavaScript SDK の使用を開始し、GPT-4 Turbo with Vision モデルをデプロイして使用します。

この SDK は OpenAI によって提供されており、Azure によって提供される Azure 固有の種類が含まれています。

リファレンスのドキュメント | ライブラリのソース コード | パッケージ (npm) | サンプル

前提条件

- Azure サブスクリプション - 無料アカウントを作成します

- Node.js の LTS バージョン

- TypeScript

- Azure CLI をローカル開発環境でのパスワードレス認証に使用する場合は、Azure CLI でサインインして必要なコンテキストを作成します。

- サポートされるリージョンに作成された Azure OpenAI リソース (利用可能なリージョンの情報をご覧ください)。 詳細については、「Azure OpenAI を使用してリソースを作成し、モデルをデプロイする」を参照してください。

Note

このライブラリは、OpenAI によって保持されます。 このライブラリの最新の更新を追跡するには、リリース履歴を参照してください。

キーとエンドポイントを取得する

Azure OpenAI に対して正常に呼び出しを行うには、エンドポイントとキーが必要です。

| 変数名 | Value |

|---|---|

ENDPOINT |

サービス エンドポイントは、Azure portal でリソースを調べるときに、[キーとエンドポイント] セクションで確認できます。 または、Azure AI Studio の [デプロイ] ページからエンドポイントを見つけることができます。 エンドポイントの例: https://docs-test-001.openai.azure.com/。 |

API-KEY |

この値は、Azure portal からリソースを確認する際に、 [Keys & Endpoint](キーとエンドポイント) セクションで確認することができます。 KEY1 または KEY2 を使用できます。 |

Azure portal でリソースに移動します。 [キーとエンドポイント] セクションは、[リソース管理] セクションにあります。 エンドポイントとアクセス キーをコピーします。これらは、API 呼び出しを認証するために両方とも必要です。 KEY1 または KEY2 を使用できます。 常に 2 つのキーを用意しておくと、サービスを中断させることなく、キーのローテーションと再生成を安全に行うことができます。

環境変数

キーとエンドポイントの永続的な環境変数を作成して割り当てます。

重要

API キーを使用する場合は、それを Azure Key Vault などの別の場所に安全に保存します。 API キーは、コード内に直接含めないようにし、絶対に公開しないでください。

AI サービスのセキュリティの詳細については、「Azure AI サービスに対する要求の認証」を参照してください。

setx AZURE_OPENAI_API_KEY "REPLACE_WITH_YOUR_KEY_VALUE_HERE"

setx AZURE_OPENAI_ENDPOINT "REPLACE_WITH_YOUR_ENDPOINT_HERE"

Node アプリケーションを作成する

コンソール ウィンドウ (cmd、PowerShell、Bash など) で、ご利用のアプリ用に新しいディレクトリを作成し、そこに移動します。 次に、npm init コマンドを実行し、package.json ファイルを使用してノード アプリケーションを作成します。

npm init

クライアント ライブラリをインストールする

次のコマンドを使用してクライアント ライブラリをインストールします。

npm install openai @azure/identity

アプリの package.json ファイルは依存関係を含めて更新されます。

画像プロンプト用の新しい JavaScript アプリケーションを作成する

azure-samples/cognitive-services-sample-data-files から画像を選択し、環境変数で画像の URL を設定します。

quickstart.ts を作成し、次のコードを貼り付けます。

import { AzureOpenAI } from "openai"; import { DefaultAzureCredential, getBearerTokenProvider } from "@azure/identity"; import type { ChatCompletion, ChatCompletionCreateParamsNonStreaming, } from "openai/resources/index"; // You will need to set these environment variables or edit the following values const endpoint = process.env["AZURE_OPENAI_ENDPOINT"] || "<endpoint>"; const imageUrl = process.env["IMAGE_URL"] || "<image url>"; // Required Azure OpenAI deployment name and API version const apiVersion = "2024-07-01-preview"; const deploymentName = "gpt-4-with-turbo"; // keyless authentication const credential = new DefaultAzureCredential(); const scope = "https://cognitiveservices.azure.com/.default"; const azureADTokenProvider = getBearerTokenProvider(credential, scope); function getClient(): AzureOpenAI { return new AzureOpenAI({ endpoint, azureADTokenProvider, apiVersion, deployment: deploymentName, }); } function createMessages(): ChatCompletionCreateParamsNonStreaming { return { messages: [ { role: "system", content: "You are a helpful assistant." }, { role: "user", content: [ { type: "text", text: "Describe this picture:", }, { type: "image_url", image_url: { url: imageUrl, }, }, ], }, ], model: "", max_tokens: 2000, }; } async function printChoices(completion: ChatCompletion): Promise<void> { for (const choice of completion.choices) { console.log(choice.message); } } export async function main() { console.log("== Get GPT-4 Turbo with vision Sample =="); const client = getClient(); const messages = createMessages(); const completion = await client.chat.completions.create(messages); await printChoices(completion); } main().catch((err) => { console.error("Error occurred:", err); });次の変更を行います。

- 適切なフィールドに GPT-4 Turbo with Vision デプロイの名前を入力します。

"url"フィールドの値を画像の URL に変更します。ヒント

URL ではなく、Base 64 でエンコードされた画像データを使うこともできます。 詳細については、GPT-4 Turbo with Vision の攻略ガイドに関するページを参照してください。

次のコマンドを使用してアプリケーションをビルドします。

tsc次のコマンドでアプリケーションを実行します。

node quickstart.js

リソースをクリーンアップする

Azure OpenAI リソースをクリーンアップして削除したい場合は、リソースまたはリソース グループを削除できます。 リソース グループを削除すると、それに関連付けられている他のリソースも削除されます。

この記事を参照して、Azure OpenAI Python .NET SDK の使用を開始し、GPT-4 Turbo with Vision モデルをデプロイして使います。

前提条件

- Azure サブスクリプション。 無料で作成できます。

- .NET 8.0 SDK

- GPT-4 Turbo with Vision モデルがデプロイされた Azure OpenAI Service リソース。 使用可能なリージョンについては、 GPT-4 および GPT-4 Turbo プレビュー モデルの可用性 に関するページを参照してください。 リソース作成の詳細については、リソース デプロイ ガイドを参照してください。

設定

キーとエンドポイントを取得する

Azure OpenAI に対して正常に呼び出しを行うには、エンドポイントとキーが必要です。

| 変数名 | Value |

|---|---|

AZURE_OPENAI_ENDPOINT |

サービス エンドポイントは、Azure portal でリソースを調べるときに、[キーとエンドポイント] セクションで確認できます。 または、Azure AI Studio の [デプロイ] ページからエンドポイントを見つけることができます。 エンドポイントの例: https://docs-test-001.openai.azure.com/。 |

AZURE_OPENAI_API_KEY |

この値は、Azure portal からリソースを確認する際に、 [Keys & Endpoint](キーとエンドポイント) セクションで確認することができます。 KEY1 または KEY2 を使用できます。 |

Azure portal でリソースに移動します。 [エンドポイントとキー] は [リソース管理] セクションにあります。 エンドポイントとアクセス キーをコピーします。これらは、API 呼び出しを認証するために両方とも必要です。 KEY1 または KEY2 を使用できます。 常に 2 つのキーを用意しておくと、サービスを中断させることなく、キーのローテーションと再生成を安全に行うことができます。

.NET アプリを作成する

dotnet newコマンドを使用して、.NET アプリを作成します。dotnet new console -n OpenAISpeech新しいアプリのディレクトリに移動します。

cd OpenAISpeech

クライアント ライブラリをインストールする

Azure.OpenAI クライアント ライブラリをインストールします。

dotnet add package Azure.AI.OpenAI

パスワードレス認証が推奨されます

パスワードレス認証は、キーベースの代替手段よりも安全であり、Azure サービスに接続するために推奨される方法です。 パスワードレス認証を使用する場合は、次の手順を完了する必要があります。

Azure.Identityパッケージを追加します。dotnet add package Azure.Identityユーザー アカウントに

Cognitive Services Userロールを割り当てます。 これは、OpenAI リソースの Azure portal の [アクセスの制御 (IAM)]>[ロールの割り当ての追加] で実行できます。az loginを使用して、Visual Studio または Azure CLI を使用して Azure にサインインします。

アプリ コードを更新する

program.csの内容を次のコードに置き換え、プレースホルダーの値を自分の値で更新します。using Azure; using Azure.AI.OpenAI; using Azure.Identity; using OpenAI.Chat; // Required for Passwordless auth var endpoint = new Uri("YOUR_AZURE_OPENAI_ENDPOINT"); var credentials = new AzureKeyCredential("YOUR_AZURE_OPENAI_KEY"); // var credentials = new DefaultAzureCredential(); // Use this line for Passwordless auth var deploymentName = "gpt-4"; // Default name, update with your own if needed var openAIClient = new AzureOpenAIClient(endpoint, credentials); var chatClient = openAIClient.GetChatClient(deploymentName); var imageUri = "YOUR_IMAGE_URL"; List<ChatMessage> messages = [ new UserChatMessage( ChatMessageContentPart.CreateTextMessageContentPart("Please describe the following image:"), ChatMessageContentPart.CreateImageMessageContentPart(new Uri(imageUri), "image/png")) ]; ChatCompletion chatCompletion = await chatClient.CompleteChatAsync(messages); Console.WriteLine($"[ASSISTANT]:"); Console.WriteLine($"{chatCompletion.Content[0].Text}");重要

運用環境では、Azure Key Vault などの安全な方法で資格情報を保存してアクセスします。 資格情報のセキュリティについて詳しくは、「Azure AI サービスのセキュリティ」をご覧ください。

アプリケーションを実行するには、Visual Studio の上部にある

dotnet runコマンドまたは実行ボタンを使用します。dotnet run

このアプリは、speechFilePath 変数に指定した場所にオーディオ ファイルを生成します。 ご利用のデバイスでこのファイルを再生し、生成されたオーディオを聞きます。

リソースをクリーンアップする

Azure OpenAI リソースをクリーンアップして削除したい場合は、リソースまたはリソース グループを削除できます。 リソース グループを削除すると、それに関連付けられている他のリソースも削除されます。